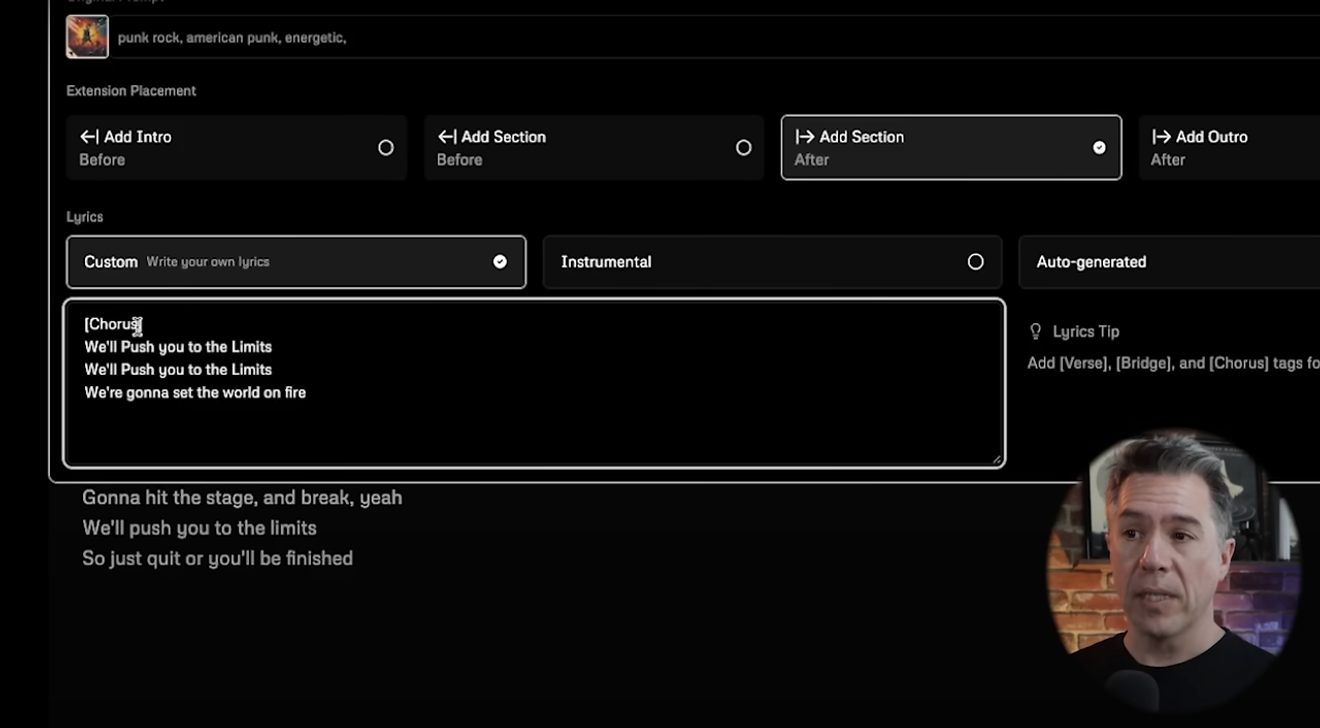

Vergangene Woche Mittwoch wurde Udio veröffentlicht, ein KI-Musikgenerierungsdienst, mit dem Musik über Text-Prompts erstellt und sogar Elemente wie Gesang und Texte hinzugefügt werden können. Nach monatelanger Closed-Beta-Phase ist der Dienst das Ergebnis eines Teams aus ehemaligen Google DeepMind-Mitarbeitern. Er hat bereits im Vorfeld hohe Erwartungen geweckt, da er von prominenten Investoren und Persönlichkeiten wie den Musikern will.i.am und Common mit einer Seed-Finanzierung von 10 Millionen US-Dollar ausgestattet wurde.

Besonders interessant ist, dass die Reviewer, die Udio im Vorfeld testen durften, übereinstimmend von einer sehr hohen Qualität der KI-generierten Musik berichten, insbesondere in Bezug auf die Live-Atmosphäre und die Gesangs-Harmonien. Darüber hinaus wird Udio zugeschrieben, die Musikproduktion zu vereinfachen und somit jedem die Möglichkeit zu geben, Komponist zu werden. Dies lässt die Medien spekulieren, dass Udio eine revolutionäre Veränderung in der Art und Weise der Musikproduktion und des Musikgenusses mit sich bringen könnte.

Diese Entwicklung ist ein weiteres Beispiel für den Trend im Bereich KI, kreative Ausdrucksformen zu demokratisieren und mehr Menschen Zugang zu künstlerischen Werkzeugen zu ermöglichen. Neben den Chancen, die sich durch die Effizienz und die benutzerfreundliche Oberfläche ergeben, tauchen aber auch einige Fragen auf, die es zu bedenken gilt.

Können diese Werkzeuge die komplexe Bedeutung und emotionale Tiefe, die menschliche Künstler in ihre Werke legen, nachbilden? Diese Frage ist entscheidend, um das Potenzial und die Grenzen der KI in der zukünftigen Kreativwirtschaft zu verstehen.

Der Musiker HAINBACH demonstriert in seinem YouTube-Content "How Textures Tell a Story", wie unkontrollierbare elektronische Klänge je nach Umgebung (ruhiger Park, Natur mit viel Gras und Bäumen) für den Hörer eine andere Bedeutung und Geschichte erzeugen, indem er sich durch diese Orte bewegt. Für ihn ist der Lyra-8 ein Instrument, das eine einzigartige Erzählung basierend auf dem sensorischen und kulturellen Kontext des Klangs erzeugt.

Der Hersteller Soma beschreibt den Lyra-8 als einen "organischen" Synthesizer, da er nicht auf dem herkömmlichen Keyboard-Layout basiert, sondern über eine kapazitive Touch-Oberfläche verfügt, die auf die körperlichen Eigenschaften des Benutzers wie Berührungsempfindlichkeit, Feuchtigkeit und Temperatur reagiert. Dies schafft eine intimere und körperlichere Umgebung für den Benutzer, intensiviert die Interaktion und macht das Musikerlebnis sehr persönlich und explorativ. Dies ist ein Beispiel für eine reiche und vielschichtige Klanglandschaft, die KI bisher nicht überzeugend nachbilden kann.

Die Welt ist bereits überfüllt mit Piep-, Beep-Geräuschen und Musikfragmenten. Wir verbringen den Großteil unserer Zeit vor Bildschirmen von Monitoren und Geräten, die mit solchen bedeutungs- und kontextarmen Klängen übersättigt sind. Daher ist die Nachricht von der Veröffentlichung eines weiteren KI-Musikgenerators sowohl spannend als auch besorgniserregend. Im Wesentlichen sollten KI-Technologien wie Udio nicht nur die musikalischen Fähigkeiten des Menschen nachahmen, sondern auch die komplexen emotionalen und kulturellen Strukturen verstehen, die der menschlichen Kreativität zugrunde liegen, und diese widerspiegeln.

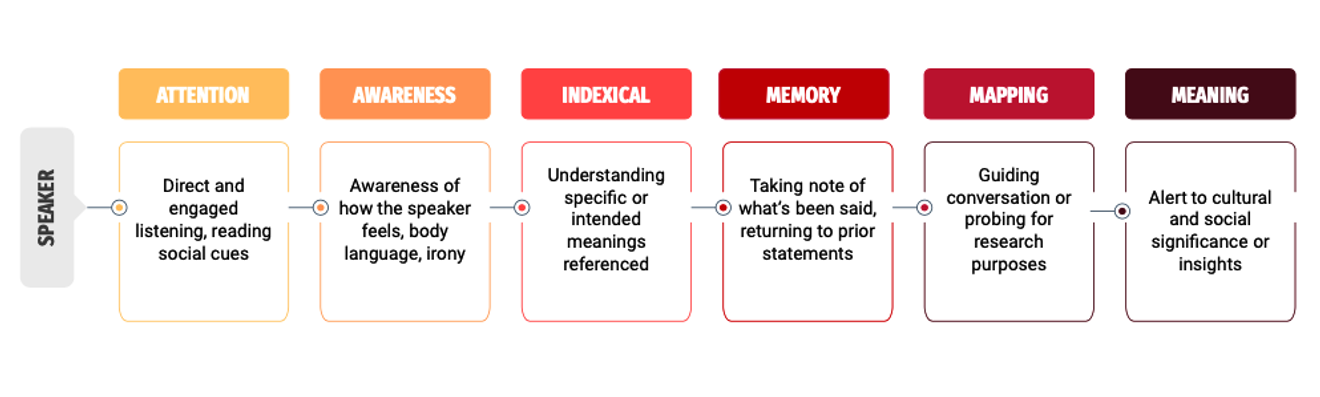

Der Kulturanthropologe Michael Powell betont in seinem Essay "The Sound of Friction", dass "Zuhören" eine sehr effektive Technik ist, um die menschliche Erfahrung und kulturelle Interaktionsfaktoren zu verstehen. Aus seinen Forschungsergebnissen lassen sich einige Erkenntnisse ableiten, die für Unternehmen, die zukünftige KI-Musikgenerierungsdienste entwickeln, relevant sein könnten.

Erstens könnte ein interaktiver Feedback-Loop sinnvoll sein. Anhand des iterativen Prozesses ethnografischer Interviews kann man die Integration eines Systems in Betracht ziehen, das auf die grundlegende Texteingabe mit Folgefragen der KI reagiert oder die generierte Musik basierend auf den ersten Reaktionen des Nutzers verfeinert und anpasst.

Zweitens kann man versuchen, mit der in der Texteingabe enthaltenen emotionalen Tonalität oder den damit verbundenen kulturellen Texturen eine feinfühligere Analyse zu erstellen und personalisierte Ergebnisse zu liefern .

Drittens, ähnlich wie ein Ethnograph im Laufe seiner Forschung immer tiefere Einblicke gewinnt, könnte man erwägen, das KI-System so zu konzipieren, dass es das Verständnis für die Präferenzen der Nutzer und die kulturellen Nuancen erweitert, indem man den Verlauf des Dialogs erweitert .

KI wie Udio stellt einen wichtigen Fortschritt in Bezug auf die Zugänglichkeit der Musikproduktion dar. Allerdings wirft dies auch die Frage auf, wie die Essenz der Kreativität und die Verbindung zur subtilen menschlichen Erfahrung, die Musik bieten kann, gefüllt werden kann. Dieser Dialog zwischen Technologie und Tradition, Innovation und Tiefe wird die zukünftige Entwicklung der Musik im digitalen Zeitalter bestimmen. Daher ist es wichtig, nicht nur die Art und Weise zu berücksichtigen, wie Klänge erzeugt werden, sondern auch, wie Klänge in unserer Gesellschaft wahrgenommen und geschätzt werden. Dies könnte der beste Weg sein, um die Ankunft einer Ära, in der ‚menschliche Kreationen‘ ein teures Etikett sind, zumindest ein wenig zu verlangsamen.

Referenzen

Kommentare0