Il y a quelque temps, quelques mois après le lancement de ChatGPT, un drame incroyable s'est déroulé au sein du conseil d'administration d'OpenAI, une entreprise à but non lucratif passée de zéro à un chiffre d'affaires annuel d'un milliard de dollars. Le PDG de l'entreprise, Sam Altman, a été licencié, puis réintégré à son poste de PDG d'OpenAI après l'annonce de son départ pour Microsoft. En général, le PDG fondateur est la force la plus puissante d'une entreprise, il est donc très rare qu'un conseil d'administration licencie un PDG fondateur, surtout s'il s'agit d'une entreprise géante d'une valeur de 80 milliards de dollars, on n'y touche pas.

Pourtant, ce drame palpitant de cinq jours a pu se produire en raison de la structure particulière d'OpenAI, liée à sa mission déclarée de « servir l'humanité ». Les trois membres indépendants du conseil d'administration qui auraient été à l'origine de la décision de licenciement d'Altman sont tous liés à l'altruisme efficace (EA, effective altruism), un concept lié à la mission de l'entreprise, qui vise à « empêcher la disparition de l'humanité et de tout ce qui est observable dans l'univers ».

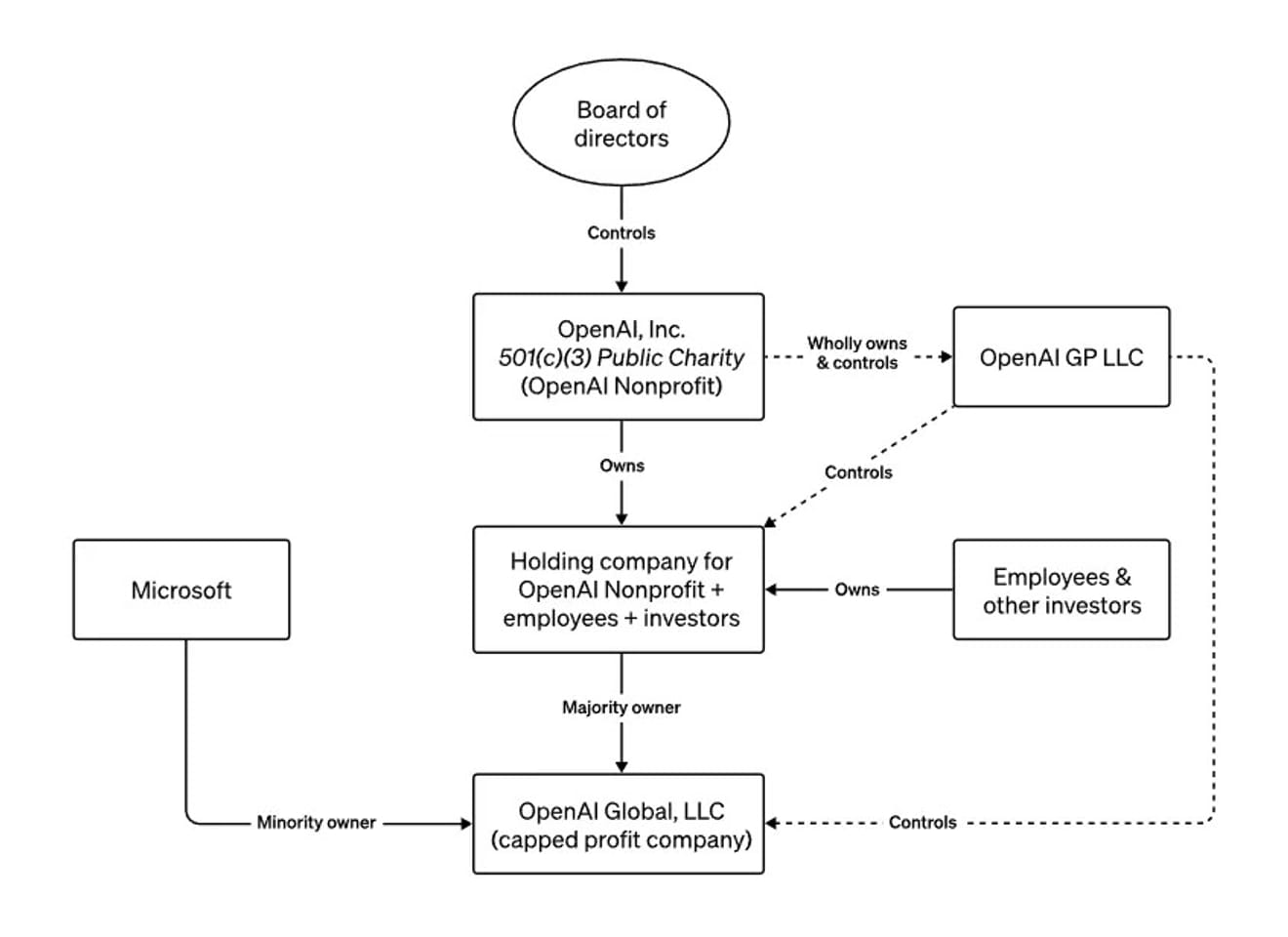

la structure du conseil d'administration d'OpenAI

Tout au long de l'année, en parcourant le monde pour alerter les médias et les gouvernements sur les risques existentiels liés aux technologies qu'il développe, Altman a présenté la structure particulière d'OpenAI, qui combine une structure à but non lucratif et une structure à but lucratif, comme un avertissement contre le développement irresponsable d'une IA puissante. Il a également mentionné dans une interview accordée à Bloomberg en juin dernier que si jamais il avait un comportement dangereux ou contraire aux intérêts de l'humanité, le conseil d'administration avait la possibilité de le renvoyer. En d'autres termes, il s'agissait d'une structure conçue intentionnellement pour permettre au conseil d'administration, qui priorise la sécurité par rapport à l'argent et à l'émergence d'une IAG incontrôlable, de licencier le PDG à tout moment.

Alors, comment devons-nous interpréter la situation actuelle où le nouveau PDG d'OpenAI est le même que l'ancien ?

Il est difficile de conclure que c'est un simple incident sans conséquence, car nous avons constaté que les décisions relatives au développement d'une IA éthique, qui pourrait avoir le plus grand impact sur notre société actuelle, sont prises sur la base d'un très petit nombre d'opinions. Sam Altman est devenu le symbole d'une époque où le monde entier se tourne vers le développement et la régulation de l'IA. Nous avons vu que le presque unique moyen externe de freiner ses décisions et ses jugements a été, en fait, supprimé, et nous avons confirmé l'importance des moyens externes supplémentaires qui pourraient exister à l'avenir.

En outre, cette situation a permis de clarifier les positions et les interprétations des tenants de la catastrophe, qui craignent que l'IA ne détruise l'humanité, des transhumanistes, qui pensent que la technologie accélérera l'arrivée d'un avenir utopique, de ceux qui croient au libre marché et au capitalisme, et de ceux qui soutiennent une réglementation stricte visant à contrôler les grandes entreprises technologiques, convaincus qu'elles ne peuvent trouver un équilibre entre les dommages potentiels des technologies perturbatrices et l'appât du gain. Et cela montre que tout cela part d'une peur de l'avenir de l'humanité avec l'IA, ce qui nous incite à prendre conscience de la nécessité de créer des communautés plus diversifiées pour prédire cet avenir.

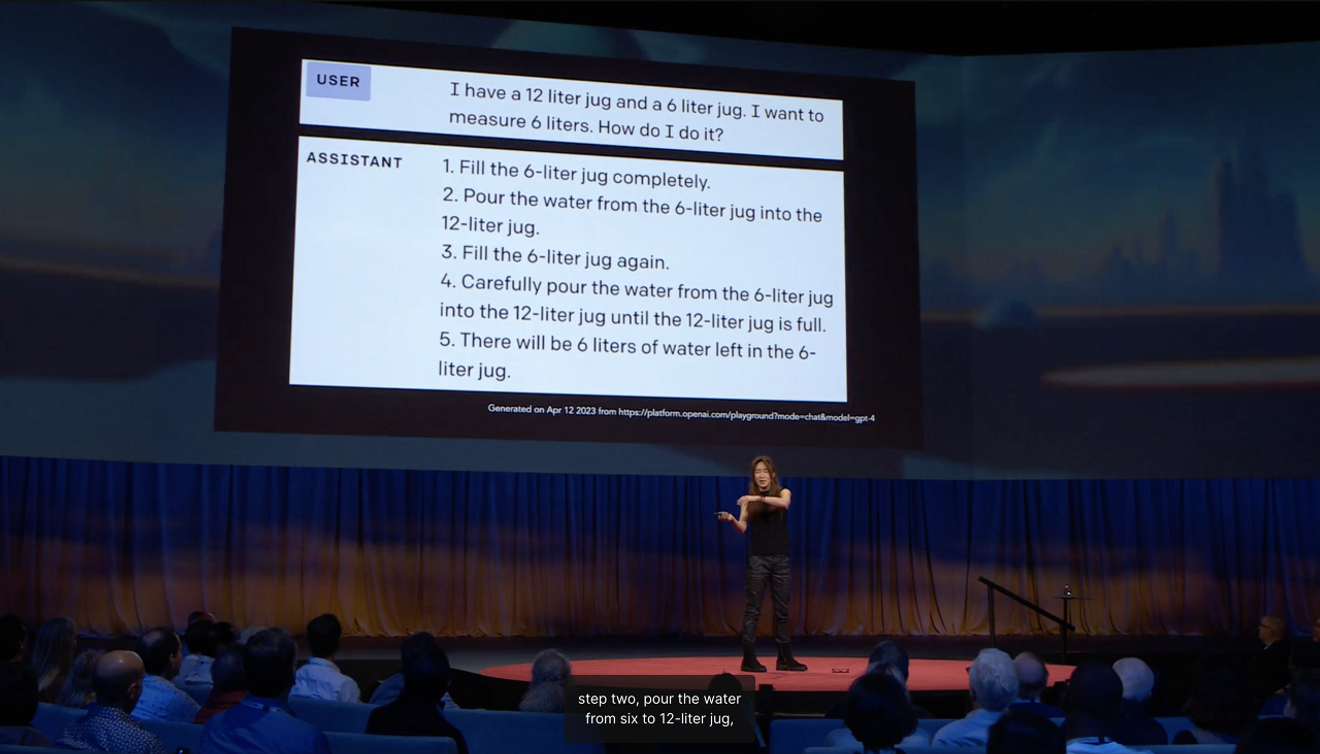

La professeure Choi Ye-jin de l'université de Washington, qui a été incluse dans la liste des 100 personnes les plus influentes au monde dans le domaine de l'IA, a expliqué dans sa conférence TED que la raison pour laquelle une IA capable de réussir différents examens nationaux ajoute des étapes inutiles et stupides pour mesurer 6 litres d'eau avec des bouilloires de 12 litres et 6 litres est due à « une insuffisance dans l'apprentissage du bon sens ».

Lorsqu'on prévoit l'avenir, on identifie souvent de nouvelles choses en tant qu'extérieurs, en prenant comme référence les « limites » qui indiquent la direction de la tendance dominante. Dans ce cas, ce qui semble être une vision stable et future de l'extérieur est toujours, dans une certaine mesure, une « attente abstraite issue d'une expérience vécue concrète » basée sur le présent. L'anthropologue américain Arjun Appadurai a soutenu que l'imagination n'est pas une capacité privée et individuelle, mais une pratique sociale. Cela signifie que diverses imaginations du futur peuvent se matérialiser, et nous pouvons interpréter cet événement comme l'un des paysages créés par l'imagination d'un futur incertain lié à l'émergence de l'IAG.

Étant donné que les attentes des leaders du secteur quant à l'avenir ont une signification politique importante, nous devrons, à l'avenir, comprendre plus profondément le futur imaginé et façonné collectivement dans divers contextes sociaux et culturels pour décider de l'avenir de l'IA. Il est temps de se demander comment créer des opportunités pour présenter activement des attentes collectives basées sur des expériences vécues concrètes au sein de communautés plus diverses.

Références

Commentaires0