Nemrégiben, a ChatGPT megjelenése utáni néhány hónappal, egy hatalmas dráma bontakozott ki az OpenAI igazgatótanácsában, amely egy nonprofit szervezet, amely a nulláról egy év alatt 1 milliárd dolláros bevételre tett szert. A cég vezérigazgatóját, Sam Altman-t elbocsátották, majd a Microsoftba való átigazolása bejelentése után ismét az OpenAI vezérigazgatójává nevezték ki. Általában a startup vezérigazgatói a vállalat legerősebb pontjai, ezért az igazgatótanács ritkán bocsátja el őket, főleg, ha egy 800 milliárd dolláros értékű óriásvállalatról van szó, akkor senki sem nyúl hozzá.

Ennek ellenére ez az öt napig tartó izgalmas dráma azért volt lehetséges, mert az OpenAI egy egyedi struktúrán alapul, amelyet a „az emberiségért” küldetésnyilatkozat köt össze. Az a három független igazgatótanácsi tag, akikről úgy tartják, hogy vezető szerepet játszottak Altman elbocsátásában, mind az „emberiség és a megfigyelhető univerzum mindenének megmentése” céljához kapcsolódnak, és mindannyian kapcsolatban állnak az úgynevezett hatékony altruizmussal (EA, effective altruism), amely a cég küldetésével összefügg.

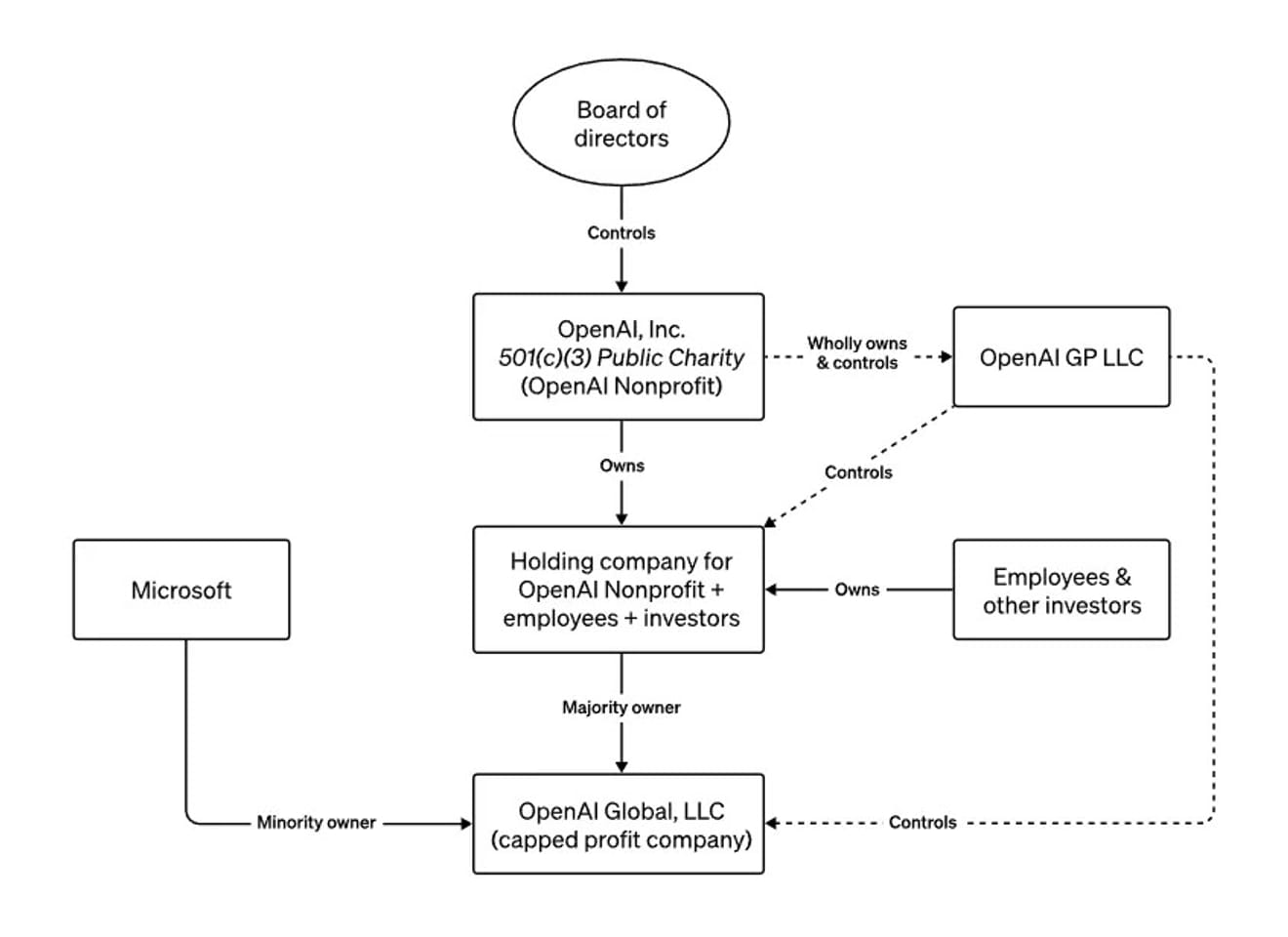

Az OpenAI igazgatótanácsának szerkezete

Altman idén egész évben bejárta a világot, és figyelmeztette a médiát és a kormányokat a fejlesztés alatt álló technológia létezési kockázataira, és az OpenAI sajátos nonprofit-profit struktúráját úgy jellemezte, mint egy figyelmeztetést a felelőtlen mesterséges intelligencia fejlesztés ellen. A Bloombergnek adott interjújában, júniusban azt is elmondta, hogy ha veszélyes vagy az emberiség érdekeivel ellentétes cselekedetet követne el, az igazgatótanács eltávolíthatja. Más szóval, egy olyan struktúra volt, amelyet szándékosan úgy terveztek, hogy az igazgatótanács, amely a pénznél is jobban a kontrollálatlan AGI megjelenésével kapcsolatos biztonságot részesíti előnyben, bármikor eltávolíthassa a vezérigazgatót.

Hogyan kell tehát tekintenünk erre a jelenlegi helyzetre, amikor az OpenAI új vezérigazgatója megegyezik az előzővel?

Nem tekinthető egyszerűen egy eseménynek, amelynek nem volt következménye, mert rávilágított arra, hogy a mai társadalomban a legnagyobb hatással bíró etikai mesterséges intelligencia fejlesztéssel kapcsolatos döntések rendkívül kis létszámú csoport véleménye alapján születnek. Sam Altman a mesterséges intelligencia fejlesztésével és szabályozásával kapcsolatos globális figyelem szimbólumává vált. Láttuk, hogy az egyetlen külső eszköz, amely megakadályozhatta volna a jövőbeli döntéseit és cselekedeteit, lényegében elavulttá vált, és ezáltal felismerhetővé vált a további külső mechanizmusok fontossága.

Ezenkívül ez a helyzet egyértelművé tette a véleménykülönbségeket azok között, akik attól tartanak, hogy a mesterséges intelligencia elpusztítja az emberiséget (katasztrófa-elmélet hívei), azok között, akik úgy vélik, hogy a technológia utópisztikus jövőt hoz (transzhumanisták), azok között, akik a szabadpiac kapitalizmusában hisznek, és azok között, akik a hatalmas pusztító technológia potenciális kárai és a pénzszerzés iránti vágy közötti egyensúly hiányát látják, és támogatják a nagy technológiai vállalatokat korlátozó szigorú szabályozást. Mindez abból a közös félelemből fakad, hogy az emberek együtt fognak élni a mesterséges intelligenciával a jövőben, ezért fontos odafigyelni arra, hogy egyre több közösségnek legyen lehetősége előrejelezni ezt a jövőt.

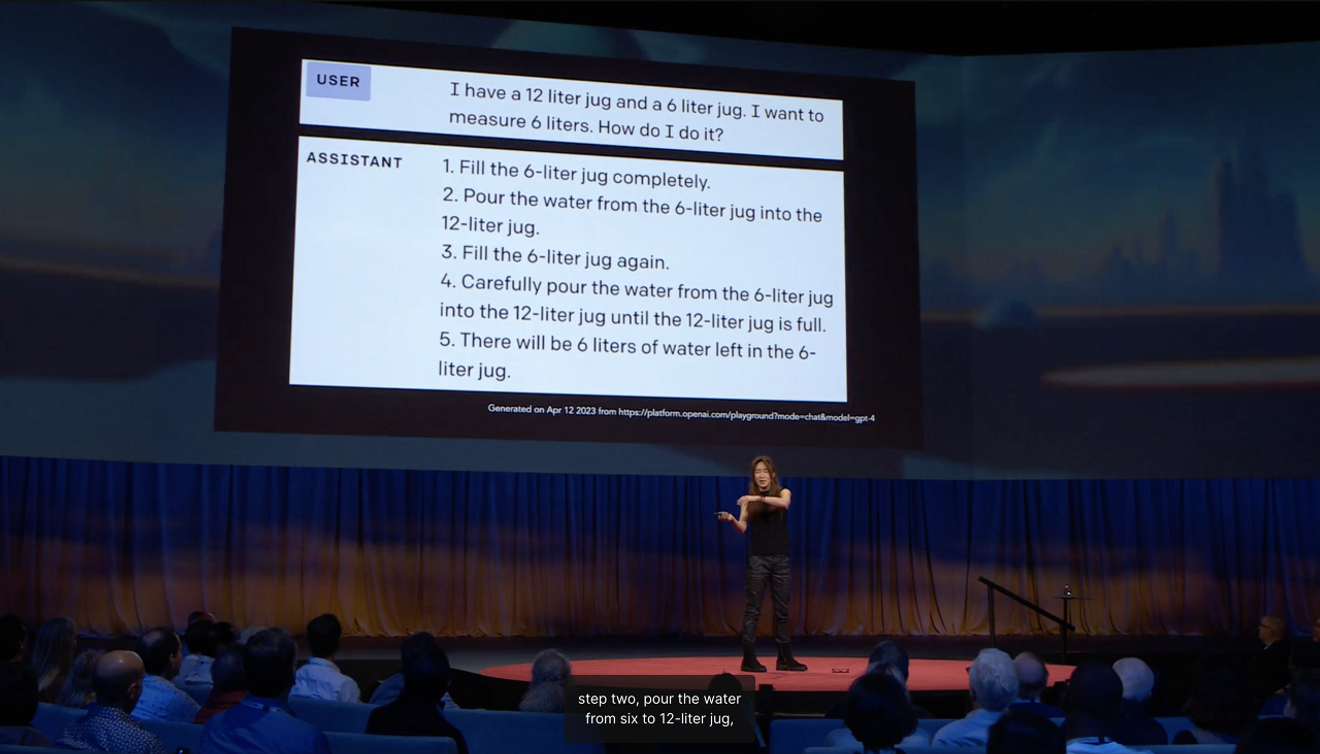

Choi Ye-jin professzor, a Washingtoni Egyetem professzora, aki a világ 100 legbefolyásosabb AI szakértője közé tartozik, TED előadásában elmagyarázta, hogy miért ad hozzá egy mesterséges intelligencia, amely képes mindenféle állami vizsgán megfelelni, felesleges lépéseket egy 6 literes vízmennyiség méréséhez 12 és 6 literes kannák használatával. Azt mondta, hogy ez a jelenség annak köszönhető, hogy az emberek nem sajátítják el kellőképpen a " józan ész fogalmáta társadalomban.

A jövő előrejelzésekor gyakran az uralkodó trendek „határvonalát” használjuk kiindulópontként, és külső szemszögből azonosítjuk az újdonságokat. Ebben az esetben az, ami kívülről nézve stabil jövőképet jelent, mindig valamilyen mértékben a jelen alapján keletkező „élénk élményből” levonható absztrakt elvárás. Arjun Appadurai amerikai antropológus azt állította, hogy a képzelőerő nem egyéni és személyes képesség, hanem társadalmi gyakorlat. Ez azt jelenti, hogy a különböző jövőképek valósággá válhatnak, és a jelenlegi helyzetet az AGI megjelenésével kapcsolatos bizonytalan jövőre vonatkozó képzelőerő által létrehozott tájkép egyikének tekinthetjük.

Mivel megállapítottuk, hogy az iparág vezetőinek a jövőre vonatkozó elképzeléseinek politikai jelentősége van, a mesterséges intelligencia jövőjének meghatározásakor a jövőre vonatkozó elképzelések különböző társadalmi és kulturális összefüggésekben történő kollektív képzelőerejének és megalkotásának mélyebb megértésére van szükség. Fel kell tennünk a kérdést, hogy miként lehet olyan lehetőségeket teremteni, amelyek lehetővé teszik a különböző közösségek számára, hogy aktívan bemutassák a kollektív elvárásaikat, amelyek az „élénk élményeken” alapulnak.

Hivatkozások

Hozzászólások0