先日、ChatGPTのリリースからわずか数か月で、無一文の状態から年間10億ドルの収益を上げるまでに成長した非営利団体OpenAIの取締役会で、信じられないほどのドラマが繰り広げられました。同社のCEOであるサム・アルトマンが解雇され、その後、マイクロソフトへの転職発表を経て、再びOpenAIのCEOに復帰することが決定されました。通常、創業CEOは会社の最も強力な存在であるため、取締役会が創業CEOを解雇することはほとんどありません。特に、企業価値が800億ドルに達する巨大企業であれば、なおさらです。

にもかかわらず、このような5日間にわたる緊迫したドラマが展開されたのは、OpenAIが「人類のために」という使命宣言に縛られた独特の構造に基づいているからです。「人類と観測可能な宇宙のすべてが消滅しないようにする」という目標に沿って、アルトマンの解雇決定を主導したとされる3人の独立した取締役会メンバーは、いずれも会社の使命と関連する効果的な利他主義(EA、effective altruism)に関係しています。

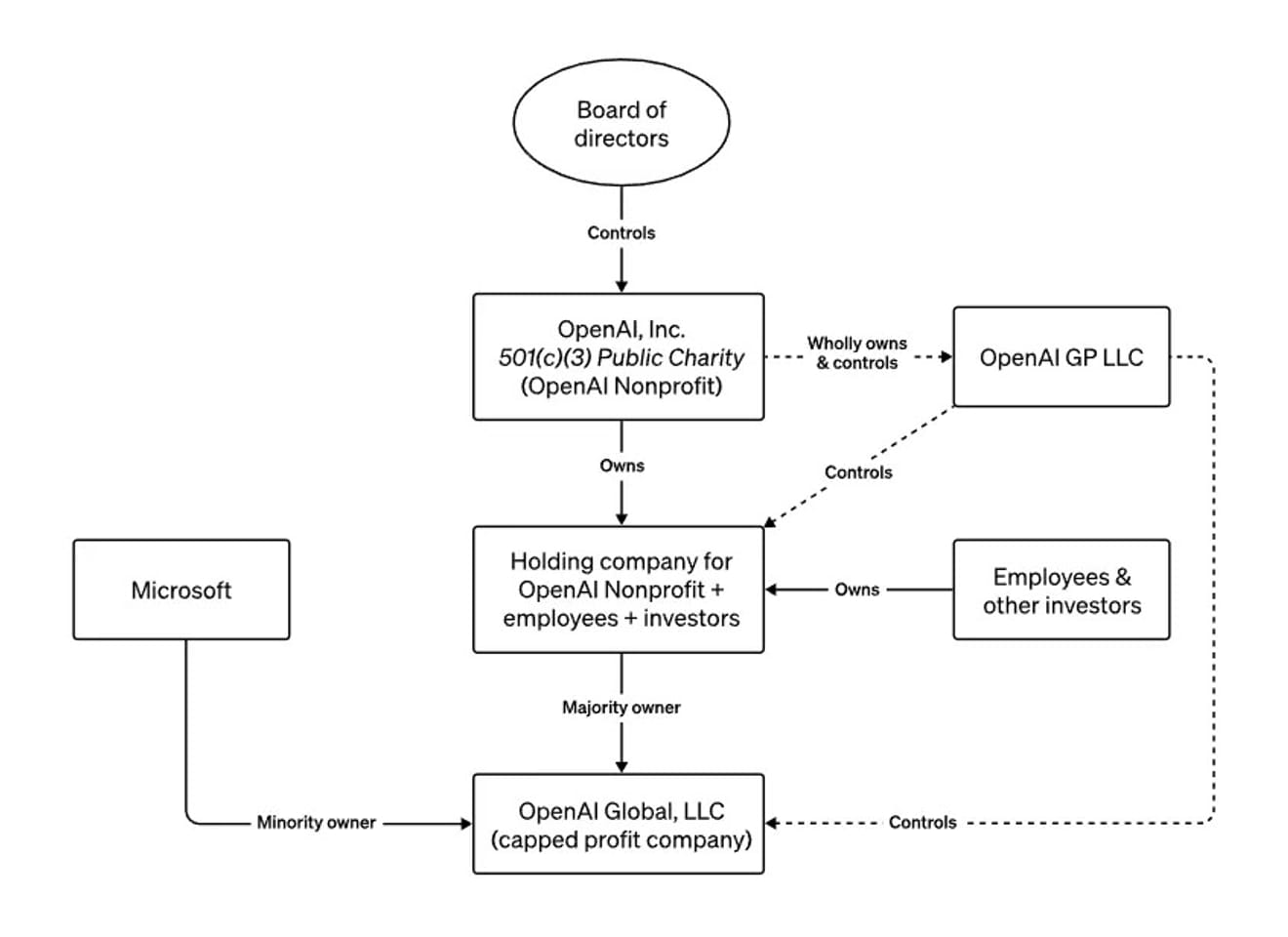

OpenAIの取締役会構造

今年、アルトマンは世界中を巡回し、メディアや政府に対して、自身が開発中の技術の存在論的なリスクについて警告してきました。そして、OpenAIの特異な非営利組織内での営利構造を、無責任な強力なAI開発に対する警鐘として描写してきました。また、彼が危険な行動をとったり、人類の利益に反する行動をとったりした場合、取締役会は彼を解雇できる構造であることを、6月のブルームバーグとのインタビューで述べていました。つまり、お金よりも制御不能なAGIの出現に関連する安全性を優先する取締役会が、いつでもCEOを解雇できるように意図的に設計された構造だったのです。

では、このOpen AIの新しいCEOが以前のCEOと同じであるという現状を、私たちはどのように捉えるべきでしょうか?

結果的に変化がなかったというハプニングで片付けることができない理由は、現代社会に最も大きな影響を与える可能性のある倫理的な人工知能開発に関する決定が、ごく少数の意見だけで行われたことを確認した点にあります。サム・アルトマンは、今やAI開発と規制に向けた世界中の視線が注がれる時代の象徴です。そして、彼の今後の判断と決断を阻止できたほぼ唯一の外部手段が、事実上廃止された過程を私たちは目撃し、その後におけるさらなる外部手段の重要性を確認しました。

また、今回の事態によって、AIが人類を滅ぼすのではないかと懸念する破滅論者、技術がユートピア的な未来を早めるだろうと考えるトランスヒューマニスト、自由奔放な市場資本主義を信じる人々、強力な破壊的な技術の潜在的な被害と金銭欲の間のバランスを取ることができないと信じ、強力な技術企業を抑止するための厳しい規制を支持する人々の立場と解釈が、より明確になりました。そして、これはいずれもAIと共に生きる人類の未来への恐怖から始まっているという点で、この未来を予測する主体を確認できるより多様なコミュニティの必要性を確認している点に注目する必要があります。

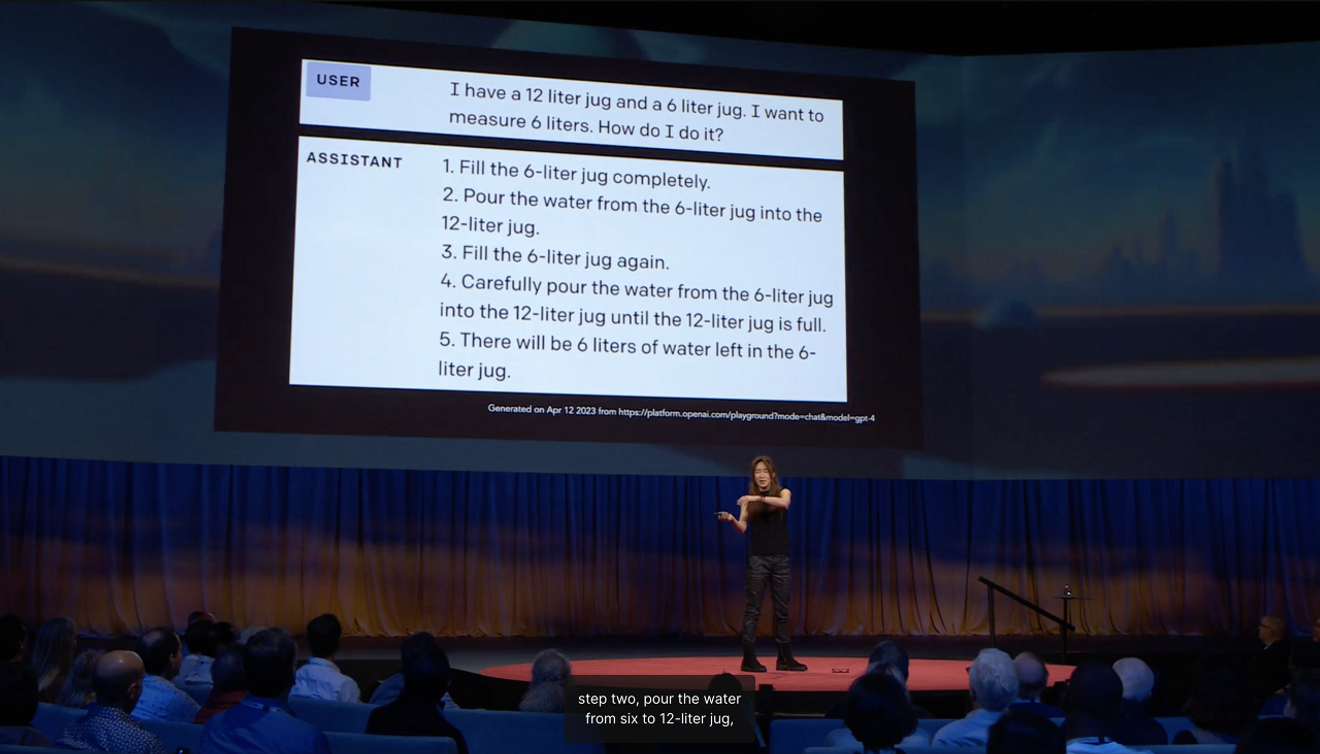

世界AI分野で最も影響力のある100人に含まれるワシントン大学のチェ・イェジン教授は、彼女のTED講演で、各種国家試験に合格する人工知能が、12リットルと6リットルのやかんを使って6リットルの水の量を測定する際に、ばかげて不必要な過程を付け加える理由は、人間が社会で習得する「常識の学習不足に起因する」と説明しました。

未来を予測する際、私たちはしばしば、主流がどこに向かっているのかを示す「限界」を基準に、外部者の立場から新しいものを識別します。このとき、外部から安定した未来のビジョンとして見えるものは、常に何らかの形で現在を基準とした「「生々しい経験」から抽象化された期待」です。アメリカの文化人類学者アルジュン・アパドゥライは、想像力を私的で個人的な能力ではなく、社会的実践であると主張しました。これは、多様な未来に対する想像力が現実になる可能性があることを意味し、今回の事態は、AGIの出現に関連する不安な未来への想像力が作り出した風景の一つであると解釈できます。

未来に向けた業界リーダーたちの期待が政治的に重要な意味を持つことを確認した以上、今後はAIの未来を決めるにあたり、多様な社会文化的な文脈において集団的に想像され構成される未来に対するより深い理解が必要となるでしょう。より多様なコミュニティにおける生々しい経験に基づく集団的な期待を積極的に提示できる機会の創造は、果たしてどのように可能なのかという問いを投げかける時です。

参考文献

コメント0