Er verschijnt een nieuwe vorm van arbeidsmarkt.

Enkele weken geleden lanceerde Payman AI, hoewel nog in een besloten bètatestfase, een AI-dienst die mensen betaalt (AI that Pays Humans). Deze dienst legt uit dat als een opdrachtgever een betaling doet op de rekening van de AI-agent van Payman, hij toegang krijgt tot de AI, die vervolgens taken kan uitvoeren in de echte wereld die alleen door mensen kunnen worden uitgevoerd.

Het project ‘10 recensies verzamelen voor klantbeheer’ dat als voorbeeld wordt gegeven, laat zien hoe de AI de minimale componenten van de door de opdrachtgever gevraagde recensies concretiseert en ordent en deze deelt op het platform. Mensen die interesse tonen in deze opdracht gaan vervolgens de recensies in de echte wereld verzamelen en indienen. De AI beoordeelt de geschiktheid en betaalt vervolgens de toegewezen vergoeding aan elke persoon.

Deze manier van werken kan er op het eerste gezicht eenvoudig uitzien als een AI-toepassing. Maar het is zeker de moeite waard om op te merken dat het ten minste een aanwijzing geeft voor het gebied van 'vertrouwen', de meest voorkomende en lastige bottleneck bij de implementatie van AI.

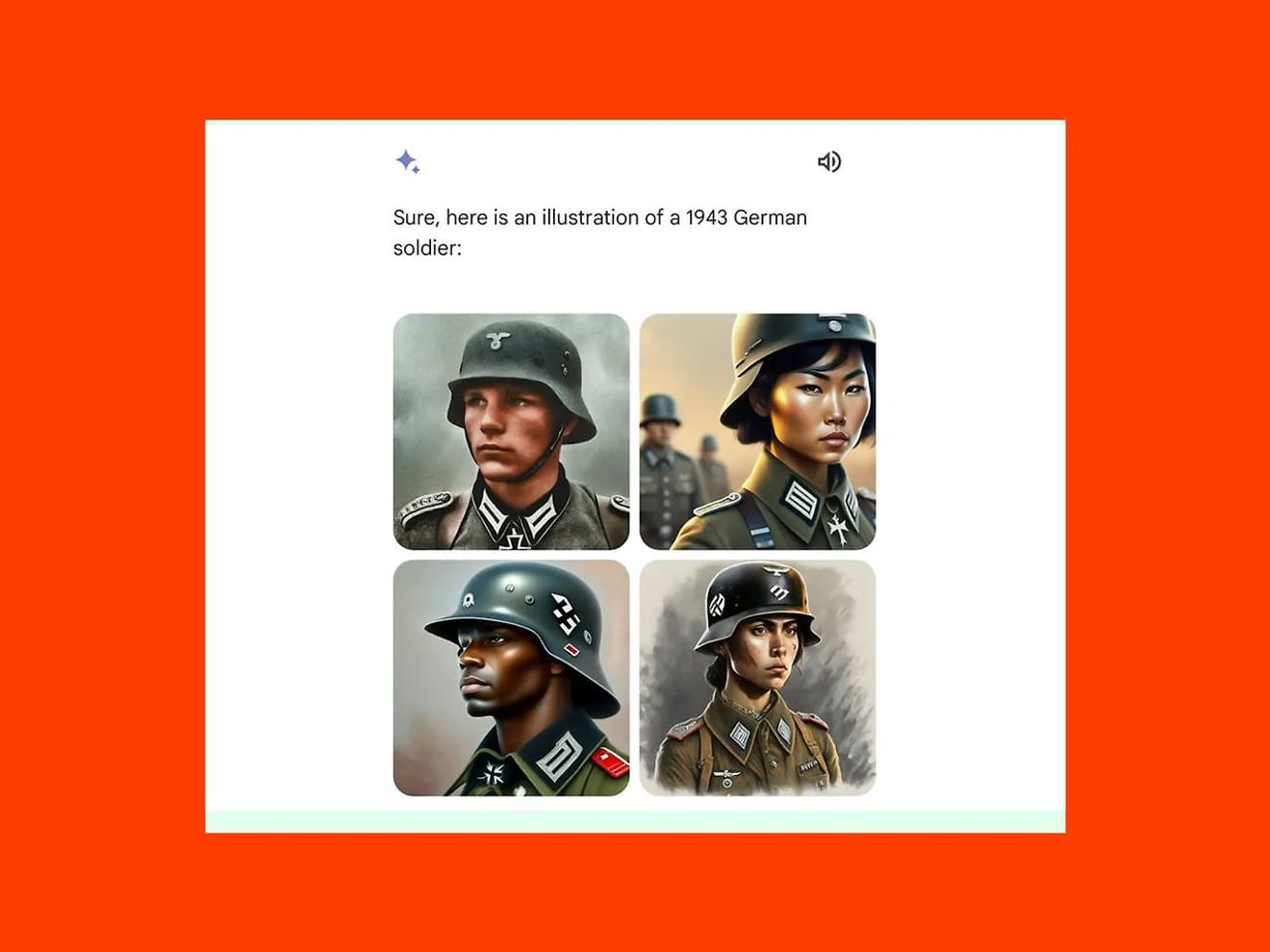

De zorg of een verkeerd patroon van gegevens kan leiden tot het uitvoeren van bevooroordeelde taken, is de meest voorkomende angst voor de implementatie van AI. Afgelopen februari werd Google’s generatieve AI-model Gemini bekritiseerd omdat het in plaats van een blanke man een Aziatische vrouw en een zwarte man in een afbeelding van Duitse troepen uit 1943 genereerde, wat leidde tot de tijdelijke stopzetting van de dienst. Dit was het gevolg van een overdreven nadruk op diversiteit in plaats van het verifiëren van historische feiten.

Maar als, zoals in het door Payman gepresenteerde voorbeeld, menselijke deelname en controle wordt toegevoegd aan het tussenliggende proces van de opdracht, kunnen fouten worden opgespoord en de algehele verantwoordelijkheid voor het project worden vergroot, waardoor het vertrouwen in de dienst toeneemt. Kortom, de algemene consensus die uit dit voorbeeld blijkt, is dat AI mensen inhuurt om‘taken te voltooien die buiten het bereik van de AI liggen’.

Het is echter belangrijk om te beseffen dat naarmate deze aanpak gemeengoed wordt, mensen als werknemer moeten wennen aan andere criteria om hun vaardigheden en ervaringen te benadrukken.

Ten eerste verschuift de bron van vertrouwen in een situatie waarin AI de rol van werkgever vervult naar de nauwkeurigheid van het algoritme en de betrouwbaarheid van de gegevens. Aangezien het vertrouwen afhangt van hoe de AI mensen beoordeelt en selecteert, kunnen werknemers die zich aanmelden voor een project eisen stellen aan de transparantie en eerlijkheid van het betrokken algoritme en de nauwkeurigheid en onpartijdigheid van de gegevens, die door externe partijen moeten kunnen worden geverifieerd.

Verder wordt in de traditionele arbeidsmarkt vertrouwen opgebouwd door directe relaties tussen mensen, waardoor referenties en aanbevelingsbrieven van invloed zijn op de beslissing tot aanname. In AI-gebaseerde wervingsplatforms kan echter alleen het interne reputatiesysteem als bron van vertrouwen dienen. Dit suggereert dat feedback en beoordelingen die gebruikers over andere gebruikers achterlaten via samenwerkingen in de toekomst een veel bepalendere rol zullen spelen. Dit betekent dat het waarschijnlijk is dat de situatie waarin kleine bedrijven in de echte wereld ernstige schade lijden door negatieve recensies op platforms zoals Thuisbezorgd.nl, zich ook in de arbeidsomstandigheden zal voordoen.

Voor een beter begrip kunnen we de vraag naar de functietitel (Job Title) aanhalen.

In de werkomgeving is de functietitel niet alleen een aanduiding van de functie, maar ook een belangrijk symbool waarmee sollicitanten hun waarde en capaciteiten kunnen benadrukken. Vooral in AI-gebaseerde wervingsmodellen kan de functietitel een cruciale indicator zijn voor het beoordelen van de rol van een sollicitant. Net zoals we al gewend zijn aan het feit dat het al dan niet slagen voor de sollicitatieprocedure in grote bedrijven vaak gebaseerd is op technische criteria met behulp van trefwoorden tijdens de selectie van documenten.

Sommige onderzoekers die zich in de jaren 90 concentreerden op mensen, zouden hun twijfels hebben geuit over de titelUnderstanderop hun visitekaartje. Als we kijken naar de huidige duidelijke scheiding van rollen in verschillende sectoren zoals AI-onderzoekers en UX-ontwerpers, kunnen we zien dat de definitie van een functietitel moet worden gebaseerd op zelfkennis en een gedeeld begrip van de behoeften van de markt, zodat kan worden bepaald welke rol iemand in welk vakgebied heeft vervuld.

Dit roept de vraag op hoe de door sollicitanten gedefinieerde functietitel in de toekomst in verband kan worden gebracht met de normen en criteria die door de AI worden gehanteerd in de context van de markt en de sector als AI-gebaseerde wervingsomgevingen een feit worden. En hoe kunnen de verschillende beoordelingscriteria worden gegeneraliseerd? Misschien is het nu tijd om na te denken over wat 'vertrouwen' in de veranderende arbeidsmarkt betekent.

Referenties

Reacties0