Enkele maanden na de lancering van ChatGPT beleefde de raad van bestuur van OpenAI, een non-profitorganisatie die in enkele maanden tijd van nul naar een jaaromzet van 1 miljard dollar steeg, een enorm drama. De CEO van het bedrijf, Sam Altman, werd ontslagen en na de aankondiging van zijn overstap naar Microsoft, werd hij weer aangesteld als CEO van OpenAI. Gewoonlijk is de oprichtende CEO de sterkste macht binnen een bedrijf, dus het is zeer zeldzaam dat een raad van bestuur een oprichtende CEO ontslaat, vooral niet bij een gigantisch bedrijf met een waarde van 80 miljard dollar.

Toch kon dit vijfdaagse, spannende drama plaatsvinden dankzij de unieke structuur van OpenAI, die gebonden is aan een missieverklaring 'voor de mensheid'. De drie onafhankelijke leden van de raad van bestuur die naar verluidt het ontslag van Altman hebben geleid, zijn allemaal verbonden met effectief altruïsme (EA), een filosofie die verband houdt met de missie van het bedrijf, met als doel 'te voorkomen dat de mensheid en alles in het waarneembare heelal verdwijnt'.

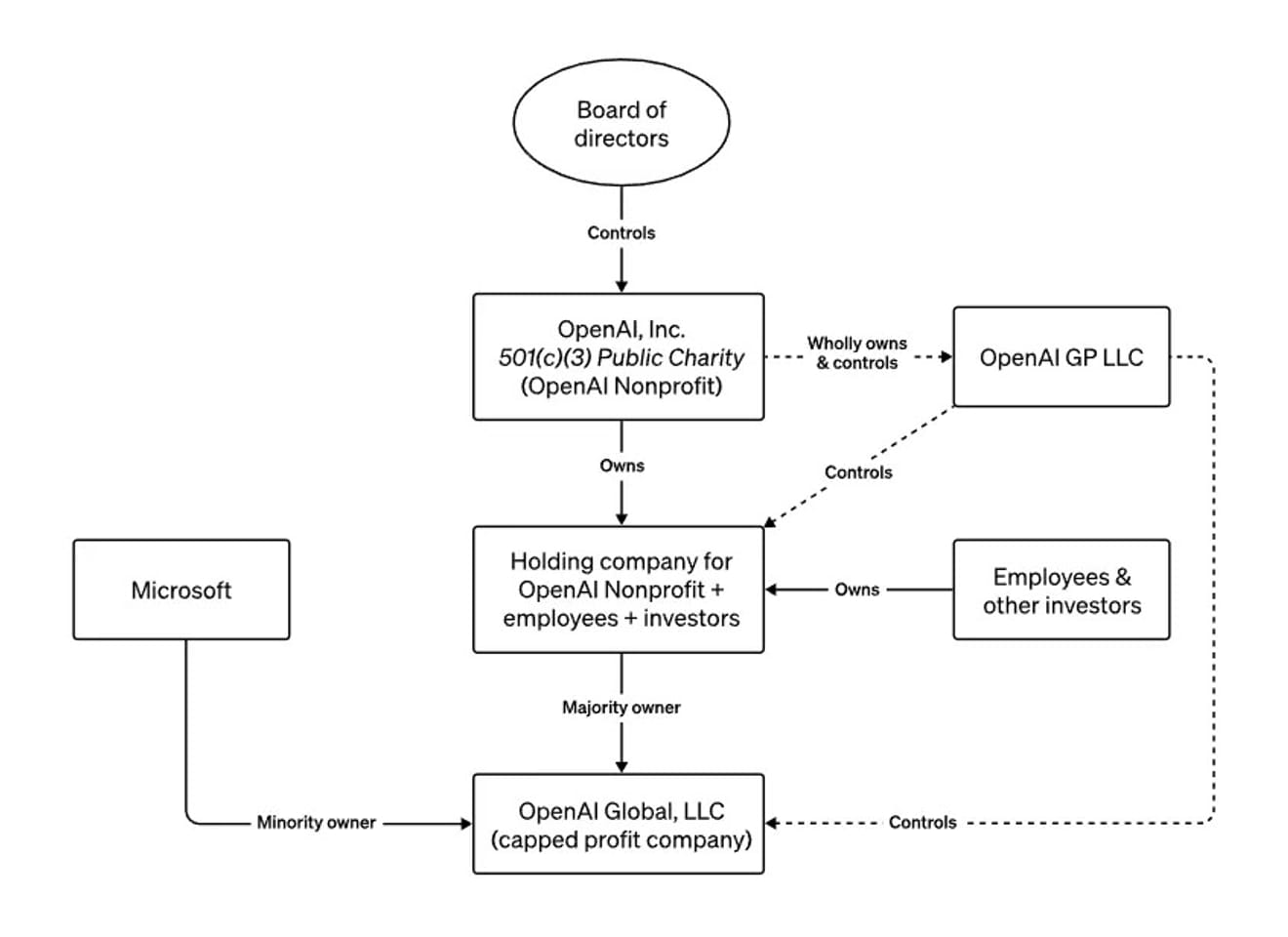

de bestuursstructuur van OpenAI

Altman reisde dit jaar de hele wereld rond om de media en regeringen te waarschuwen voor de existentiële risico's van de technologie die hij aan het ontwikkelen is. Hij beschreef de ongebruikelijke non-profit/profitstructuur van OpenAI als een waarschuwing tegen de onverantwoordelijke ontwikkeling van krachtige AI. In een interview met Bloomberg in juni gaf hij aan dat de raad van bestuur hem zou kunnen ontslaan als hij zich zou bezighouden met gevaarlijk of schadelijk gedrag voor de mensheid. Met andere woorden, de structuur was opzettelijk zo ontworpen dat een raad van bestuur, die de veiligheid boven alles stelt in verband met de opkomst van een onbeheersbare AGI, de CEO op elk moment kan ontslaan.

Hoe moeten we dan kijken naar de huidige situatie, waarin de nieuwe CEO van OpenAI dezelfde is als de vorige?

Het is moeilijk om dit af te doen als een gebeurtenis die met niets is geëindigd, omdat we hebben vastgesteld dat beslissingen over de ethische ontwikkeling van kunstmatige intelligentie, die de grootste impact kunnen hebben op onze huidige samenleving, worden genomen door een zeer kleine groep mensen. Sam Altman is nu een symbool van een tijdperk waarin de hele wereld zijn aandacht richt op de ontwikkeling en regulering van AI. We hebben gezien dat het enige externe middel dat hem had kunnen tegenhouden, feitelijk is afgeschaft, en we hebben de noodzaak van verdere externe middelen bevestigd.

Bovendien is door deze situatie de standpunten van verschillende groepen mensen duidelijker geworden: de apocalyptici die bang zijn dat AI de mensheid zal vernietigen, de transhumanisten die geloven dat technologie een utopische toekomst zal versnellen, degenen die geloven in een vrijemarkteconomie, en degenen die pleiten voor strengere regelgeving voor grote technologiebedrijven, omdat ze geloven dat het onmogelijk is om een evenwicht te vinden tussen de potentiële gevaren van krachtige, disruptieve technologie en de drang om winst te maken. En dit alles komt voort uit de angst voor de toekomst van de mens met AI. In dat opzicht is het belangrijk om op te merken dat we meer diverse communities nodig hebben om deze toekomst te voorspellen.

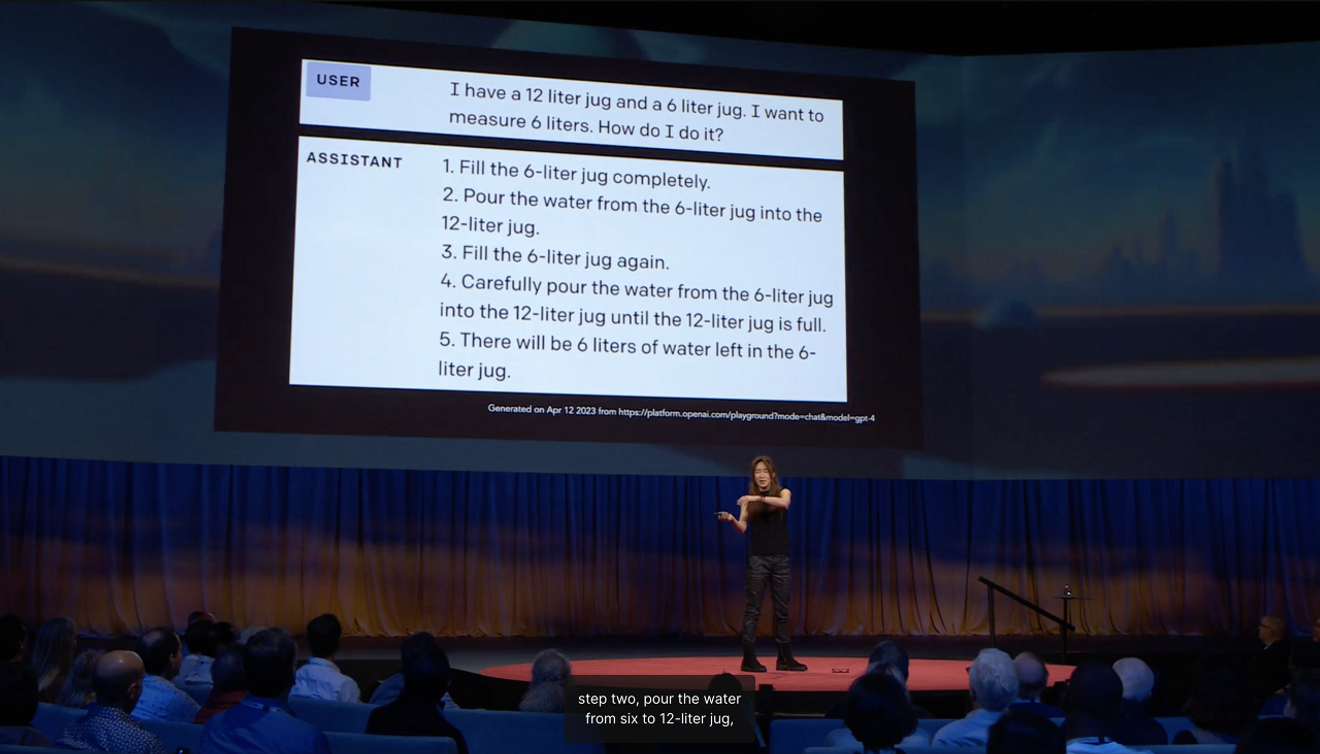

Ye-Jin Choi, professor aan de Universiteit van Washington, die tot de 100 meest invloedrijke personen ter wereld op het gebied van AI behoort, legde in haar TED-talk uit dat de reden waarom AI die slaagt voor verschillende nationale examens, op een domme, onnodige manier 6 liter water meet met behulp van kannen van 12 en 6 liter, te wijten is aaneen gebrek aan 'common sense' (gezond verstand) in de training.

Bij het voorspellen van de toekomst identificeren we vaak nieuwe dingen vanuit een externe positie, gebaseerd op de 'grenzen' die aangeven waar de mainstream naartoe beweegt. In dat geval is wat vanuit een externe positie als een stabiele toekomstvisie wordt gezien, altijd in zekere mate gebaseerd op het heden, en is het een“levende ervaring” die is geabstraheerd uit verwachtingen. De Amerikaanse antropoloog Arjun Appadurai betoogde dat verbeeldingskracht geen persoonlijke en individuele vaardigheid is, maar een sociale praktijk. Dit betekent dat verschillende verbeeldingen van de toekomst werkelijkheid kunnen worden. Deze gebeurtenis kan worden geïnterpreteerd als een van de landschappen die zijn gecreëerd door de verbeelding van een onzekere toekomst met betrekking tot de opkomst van AGI.

Nu we hebben gezien dat de verwachtingen van de leiders in de sector een belangrijke politieke betekenis hebben, zullen we in de toekomst een dieper begrip nodig hebben van de toekomst die collectief wordt voorgesteld en gevormd binnen verschillende sociale en culturele contexten, om de toekomst van AI te bepalen. Het is nu tijd om de vraag te stellen: hoe kunnen we kansen creëren om collectief verwachtingen te presenteren die gebaseerd zijn op levendige ervaringen in verschillende communities?

Referenties

Reacties0