Pojawia się nowy rodzaj rynku pracy.

Kilka tygodni temu Payman AI wypuścił usługę AI, która płaci ludziom (AI that Pays Humans), która jest obecnie w fazie prywatnej bety. Usługa ta wyjaśnia, że klienci mogą dokonać płatności na konto agenta AI Payman, a następnie udzielić AI dostępu do wykonywania zadań, które w rzeczywistości mogą wykonywać tylko ludzie.

Jako przykład podano projekt „Zebranie 10 opinii w ramach obsługi klienta”, w którym AI określa i organizuje minimalne wymagania dotyczące opinii żądanych przez klienta, udostępniając je na platformie. Osoby zainteresowane tym zleceniem wychodzą w rzeczywisty świat, aby zbierać i przesyłać opinie, które AI ocenia pod kątem odpowiedniości, a następnie przeprowadza płatności przydzielone do każdej osoby.

To podejście może się wydawać na razie prostym przykładem zastosowania AI. Niemniej jednak jest godne uwagi, ponieważ oferuje wskazówki dotyczące obszaru „zaufania”, który jest najczęstszą i najtrudniejszą do rozwiązania wąską szyją w wdrożeniu AI.

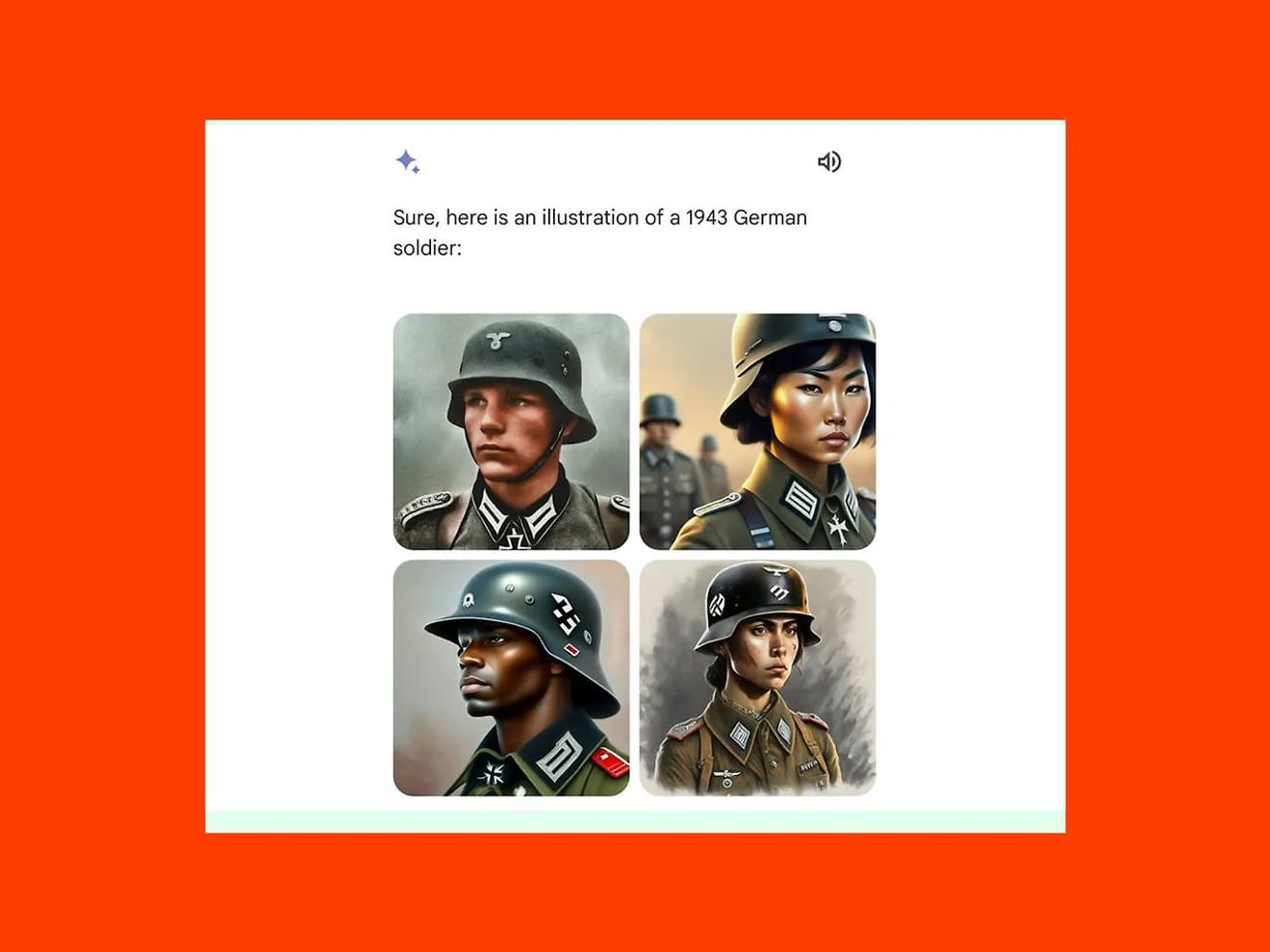

Obawa o to, czy można zapobiegać sytuacjom, w których AI uczy się błędnych wzorców danych i wykonuje stronnicze zadania, jest jednym z najbardziej typowych lęków związanych z wdrażaniem AI. W lutym tego roku model generatywny AI Google'a, Gemini, został skrytykowany za generowanie obrazów azjatyckich kobiet i czarnych mężczyzn zamiast białych mężczyzn na obrazach niemieckich żołnierzy z 1943 roku, co doprowadziło do tymczasowego zawieszenia usługi. Był to wynik nadmiernego skupienia się na różnorodności w ostatnim czasie zamiast na weryfikacji faktów historycznych.

Jednak w przypadku Payman, jak pokazano w przedstawionym przykładzie, włączenie etapu ludzkiego udziału i przeglądu w procesie realizacji zlecenia umożliwia wykrywanie błędów i zwiększenie odpowiedzialności za cały projekt, co z kolei zwiększa zaufanie do usługi. Podsumowując, powszechna zgoda płynąca z tego przypadku wskazuje, że AI zatrudnia ludzi, aby„zrealizować zadania wykraczające poza możliwości AI”.

Jednak wraz z upowszechnieniem się tego podejścia ludzie, jako pracownicy, muszą przyzwyczaić się do innych niż dotychczas kryteriów prezentacji swoich umiejętności i doświadczenia.

Po pierwsze, w sytuacji, gdy AI pełni rolę pracodawcy, źródłem zaufania staje się dokładność algorytmów i wiarygodność danych. Ponieważ poziom zaufania zależy od tego, w jaki sposób AI ocenia i wybiera ludzi, osoby ubiegające się o pracę będą mogły wymagać dostarczenia kryteriów zewnętrznych weryfikujących przejrzystość i uczciwość stosowanych algorytmów oraz dokładność i brak uprzedzeń danych.

Ponadto, w tradycyjnym rynku pracy zaufanie tworzy się w bezpośrednich relacjach międzyludzkich, dlatego opinie i listy polecające miały wpływ na decyzje o zatrudnieniu. W przypadku platform pracy opartych na sztucznej inteligencji jedynie wewnętrzny system reputacji może być źródłem zaufania. Sugeruje to, że opinie lub recenzje, które użytkownicy dodają na temat innych użytkowników, z którymi współpracują, będą odgrywać bardziej decydującą rolę niż dotychczas. Oznacza to, że w środowisku pracy może wystąpić zjawisko znane z platformy do zamawiania jedzenia, w którym przedsiębiorcy ponoszą znaczne szkody w wyniku „bombardowania negatywnymi opiniami”.

Aby lepiej zrozumieć, można wziąć pod uwagę kwestię tytułu stanowiska.

W środowisku pracy tytuł stanowiska nie tylko odzwierciedla obowiązki, ale także jest ważnym symbolem, który pozwala kandydatom na zaprezentowanie swojej wartości i umiejętności. W szczególności w przypadku modeli zatrudnienia opartych na AI tytuł stanowiska może być kluczowym wskaźnikiem oceny roli kandydata. Podobnie jak w przypadku przeprowadzania przez nas procesu rekrutacji w dużych firmach, w którym decyzja o zakwalifikowaniu się do następnego etapu rekrutacji opiera się na kluczowych słowach.

Pod koniec lat 90. XX wieku niektórzy badacze skupieni na człowieku mieli wątpliwości co do tytułu Understanderwpisanego na ich wizytówkach. Biorąc pod uwagę obecne wyraźne różnice w wymaganych rolach w zależności od branży, np. badacz AI, projektant UX, możemy stwierdzić, że definicja tytułu stanowiska powinna opierać się na świadomości siebie i zrozumieniu potrzeb rynku.

Oznacza to, że w nadchodzącym świecie pracy opartym na sztucznej inteligencji tytuł stanowiska, który kandydat sam określa, będzie musiał być powiązany ze zrozumieniem rynku i branży przez AI. Rodzi to pytanie, jak stworzyć rozmaite kryteria oceny i jak je spopularyzować. Być może nadszedł czas, abyśmy poważniej zastanowili się nad znaczeniem „zaufania” w zmieniającym się rynku pracy.

Źródła

Komentarze0