Um novo tipo de mercado de trabalho está surgindo.

Há algumas semanas, a Payman AI lançou um serviço de IA que paga humanos (AI that Pays Humans), ainda em fase de teste beta fechado. O serviço explica que o cliente faz um pagamento na conta do agente de IA da Payman e concede acesso à IA para realizar tarefas no mundo real que só humanos podem fazer.

O projeto de 'coleta de 10 avaliações para gerenciamento de clientes', apresentado como exemplo, mostra como a IA detalha e organiza os componentes mínimos das avaliações solicitadas pelo cliente e as compartilha na plataforma. Pessoas interessadas nesse pedido saem ao mundo real para coletar e enviar avaliações. A IA então verifica a adequação e paga a cada pessoa o valor alocado para a tarefa.

Essa abordagem pode parecer um caso de uso simples de IA no momento. No entanto, é digno de nota, pois fornece pistas para o gargalo mais comum e difícil de resolver na adoção da IA: a 'confiança'.

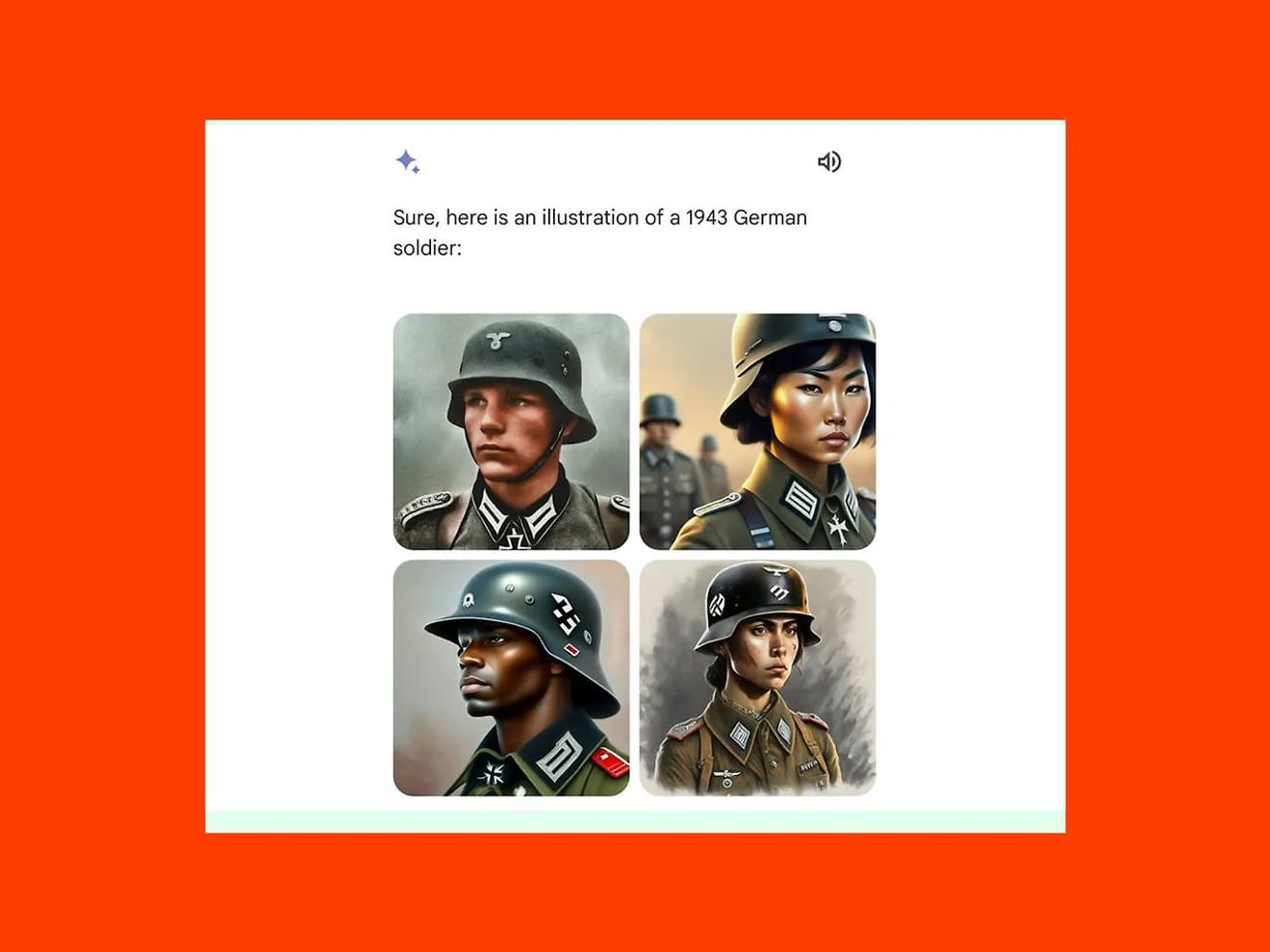

A preocupação com a possibilidade de a IA aprender padrões de dados incorretos e realizar tarefas tendenciosas é um dos principais medos relacionados à adoção da IA. Em fevereiro, o modelo de IA generativo Gemini do Google gerou imagens de mulheres asiáticas e homens negros em vez de homens brancos em uma imagem do exército alemão de 1943, recebendo críticas e levando à suspensão temporária do serviço. Foi o resultado de uma ênfase excessiva na diversidade em relação à verificação de fatos históricos.

No entanto, como no exemplo apresentado pela Payman, a inclusão de uma etapa de participação e revisão humana no processo intermediário da tarefa permite identificar erros e aumentar a responsabilidade geral do projeto, aumentando a confiabilidade do serviço. Em resumo, o consenso geral derivado deste caso é que a IA emprega humanos para‘completar tarefas que excedem sua capacidade.’ É isso que se observa.

No entanto, à medida que essa abordagem se torna mais comum, é importante notar que os humanos, como trabalhadores, precisam se acostumar com novos critérios para mostrar suas habilidades e experiência.

Primeiro, em um cenário em que a IA atua como empregadora, a fonte de confiança muda para a precisão do algoritmo e a confiabilidade dos dados. Como o nível de confiança é determinado por como a IA avalia e seleciona as pessoas, os trabalhadores humanos que se candidatam a projetos podem exigir que critérios externos sejam estabelecidos para garantir que o algoritmo seja transparente e justo, e que os dados sejam precisos e imparciais.

Além disso, no mercado de trabalho tradicional, a confiança se forma em relacionamentos interpessoais diretos, com avaliações e recomendações influenciando as decisões de contratação. No entanto, em plataformas de emprego baseadas em IA, apenas o sistema de reputação interno pode ser a fonte de confiança. Isso sugere que os comentários e avaliações deixados pelos usuários sobre outros usuários com quem colaboraram serão mais decisivos do que antes. Isso significa que há uma alta probabilidade de que situações em que trabalhadores autônomos sofrem graves perdas devido a ataques de avaliações negativas no aplicativo de entrega 'Baedal Minjok' também possam ocorrer no ambiente de trabalho.

Para melhor compreensão, podemos considerar a questão do 'Cargo' (Job Title).

No ambiente de trabalho, o 'Cargo' não é apenas uma descrição de função, mas também um símbolo importante para os candidatos demonstrarem seu valor e habilidades. Em particular, em modelos de emprego baseados em IA, o 'Cargo' pode ser usado como um indicador fundamental para determinar o papel do candidato. Assim como já estamos familiarizados com o fato de que a aprovação na seleção de documentos em processos de contratação de grandes empresas é decidida por critérios de habilidades baseados em palavras-chave.

Na metade da década de 1990, alguns pesquisadores centrados em humanos teriam se questionado sobre o título 'Understander' (Entendedor) em seus cartões de visita. Considerando a clara diferenciação de papéis exigidos por diferentes setores, como pesquisadores de IA e designers UX atualmente, podemos ver que a definição de 'Cargo' deve ser feita com base na autoconsciência do candidato sobre o que ele fez em qual área e na compreensão compartilhada da necessidade do mercado.

Isso leva à questão de até que ponto a descrição do 'Cargo' definida por um candidato em um ambiente de trabalho baseado em IA pode se conectar aos padrões de entendimento do mercado e do setor que a IA usa para julgar e avaliar. E como podemos universalizar vários critérios de julgamento relacionados a isso? Talvez este seja o momento de refletir mais profundamente sobre o que é 'confiança' em um mercado de trabalho em mudança.

Referências

Comentários0