Появляется новый тип рынка труда.

Несколько недель назад Payman AI запустил сервис AI, который платит людям (AI that Pays Humans), находящийся в стадии закрытого бета-тестирования. В описании сервиса говорится, что заказчик вносит оплату на счет AI-агента Payman, предоставляя ему доступ к выполнению задач, которые в реальном мире могут выполнять только люди.

В качестве примера приведён проект «Сбор 10 отзывов для управления клиентами». AI конкретизирует и упорядочивает минимальные требования к отзывам, запрошенным заказчиком, и публикует их на платформе. Затем люди, заинтересованные в этом заказе, выходят в реальный мир, собирают и отправляют отзывы. AI проверяет их на соответствие требованиям и выплачивает каждому участнику назначенную сумму.

Такой подход может показаться простым примером применения AI. Однако он заслуживает внимания, поскольку, по крайней мере, предлагает подсказку в решении одной из самых распространенных и трудноразрешимых проблем внедрения AI – проблемы «доверия».

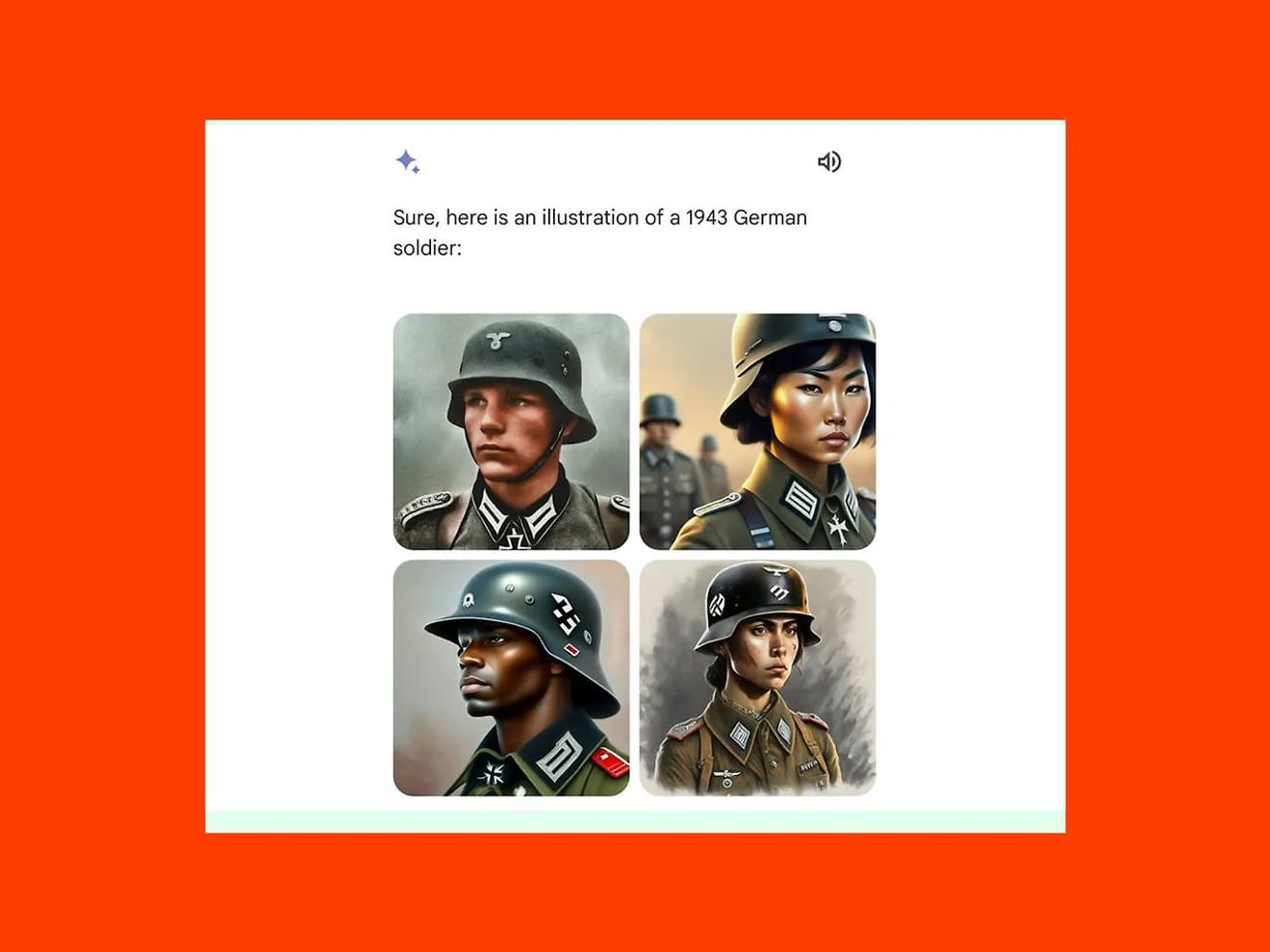

Один из главных страхов, связанных с внедрением AI, заключается в том, возможно ли предотвратить ситуации, когда из-за обучения на неправильных шаблонах данных AI выполняет предвзятые действия. В феврале этого года модель генеративного AI Gemini от Google создала изображения 1943 года, на которых вместо белых мужчин были изображены азиатские женщины и чернокожие мужчины, что вызвало критику и привело к временной приостановке работы сервиса. Это результат чрезмерной концентрации на разнообразии, которая в последнее время стала приоритетной, вместо проверки исторических фактов.

Однако, если включить в процесс выполнения поручения этап участия и проверки человека, как в примере, представленном Payman, то можно выявлять ошибки и повышать общую ответственность за проект, что, в свою очередь, повышает доверие к сервису. Иными словами, в данном случае можно наблюдать общее мнение о том, что AI нанимает людей, чтобы«выполнять задачи, которые выходят за рамки его возможностей» .

Однако по мере распространения такого подхода людям, как работникам, необходимо привыкать к новым критериям демонстрации своих навыков и опыта, отличным от прежних.

Во-первых, в ситуации, когда AI выступает в роли работодателя, источник доверия смещается на точность алгоритмов и достоверность данных. Уровень доверия определяется тем, как AI оценивает и отбирает людей. Поэтому человек, подающий заявку на участие в проекте, может потребовать наличия внешних критериев, позволяющих проверить, насколько прозрачен и справедлив используемый алгоритм, а также насколько точны и беспристрастны данные.

Кроме того, на традиционном рынке труда доверие формируется в результате непосредственного общения между людьми, поэтому отзывы и рекомендации влияют на принятие решения о приёме на работу. На AI-платформах трудоустройства единственным источником доверия может стать внутренняя система репутации. Это говорит о том, что обратная связь и отзывы, которые пользователи оставляют друг о друге в ходе совместной работы, будут играть более решающую роль, чем прежде. Это означает, что ситуация, когда в реальной жизни владельцы малого бизнеса страдают от «нападений» негативных отзывов в сервисе доставки еды, может возникнуть и в сфере трудоустройства.

Для более ясного понимания можно рассмотреть вопрос о названии должности (Job Title).

В сфере трудоустройства название должности – это не просто обозначение должностных обязанностей, но и важный символ, позволяющий соискателю продемонстрировать свою ценность и компетенции. В частности, в AI-моделях трудоустройства название должности может использоваться в качестве ключевого показателя для определения роли соискателя. Так же, как мы привыкли к тому, что в крупных компаниях при отборе кандидатов на этапе проверки документов решающее значение имеют ключевые слова, описывающие навыки.

В середине 90-х некоторые исследователи, ориентированные на человека, недоумевали, увидев в своих визитных карточках название должностиUnderstander. Если учесть чёткое разделение ролей в зависимости от требований отрасли, например, исследователь AI или UX-дизайнер, то можно понять, что определение названия должности должно основываться на самосознании соискателя и понимании потребностей рынка, чтобы определить, в какой области и какую роль он выполнял.

Это неизбежно приводит к вопросу: насколько название должности, которое соискатель определяет для себя в условиях AI-трудоустройства, соответствует критериям понимания рынка и отрасли, используемым AI для принятия решений? И как можно унифицировать различные критерии оценки? Возможно, сейчас самое время задуматься о том, что такое «доверие» в меняющемся мире труда.

Ссылки

Комментарии0