Недавно, всего через несколько месяцев после запуска ChatGPT, в совете директоров OpenAI, некоммерческой организации, выручка которой за год выросла от нуля до 1 миллиарда долларов, разыгралась невероятная драма. Генеральный директор компании Сэм Альтман был уволен, а затем, после объявления о его переходе в Microsoft, вновь назначен на пост генерального директора OpenAI. Обычно основатель и генеральный директор компании является самой сильной фигурой, поэтому случаи увольнения таких руководителей советом директоров крайне редки, особенно в случае крупных компаний с рыночной капитализацией в 80 млрд долларов, к которым и относится OpenAI.

Несмотря на это, такая напряженная пятидневная драма стала возможной благодаря уникальной структуре OpenAI, основанной на миссии «служить человечеству». Три независимых члена совета директоров, которые, как сообщается, стали инициаторами решения об увольнении Альтмана, связаны с эффективным альтруизмом (EA, effective altruism), тесно связанным с миссией компании, направленной на то, чтобы «человечество и вся наблюдаемая Вселенная не исчезли».

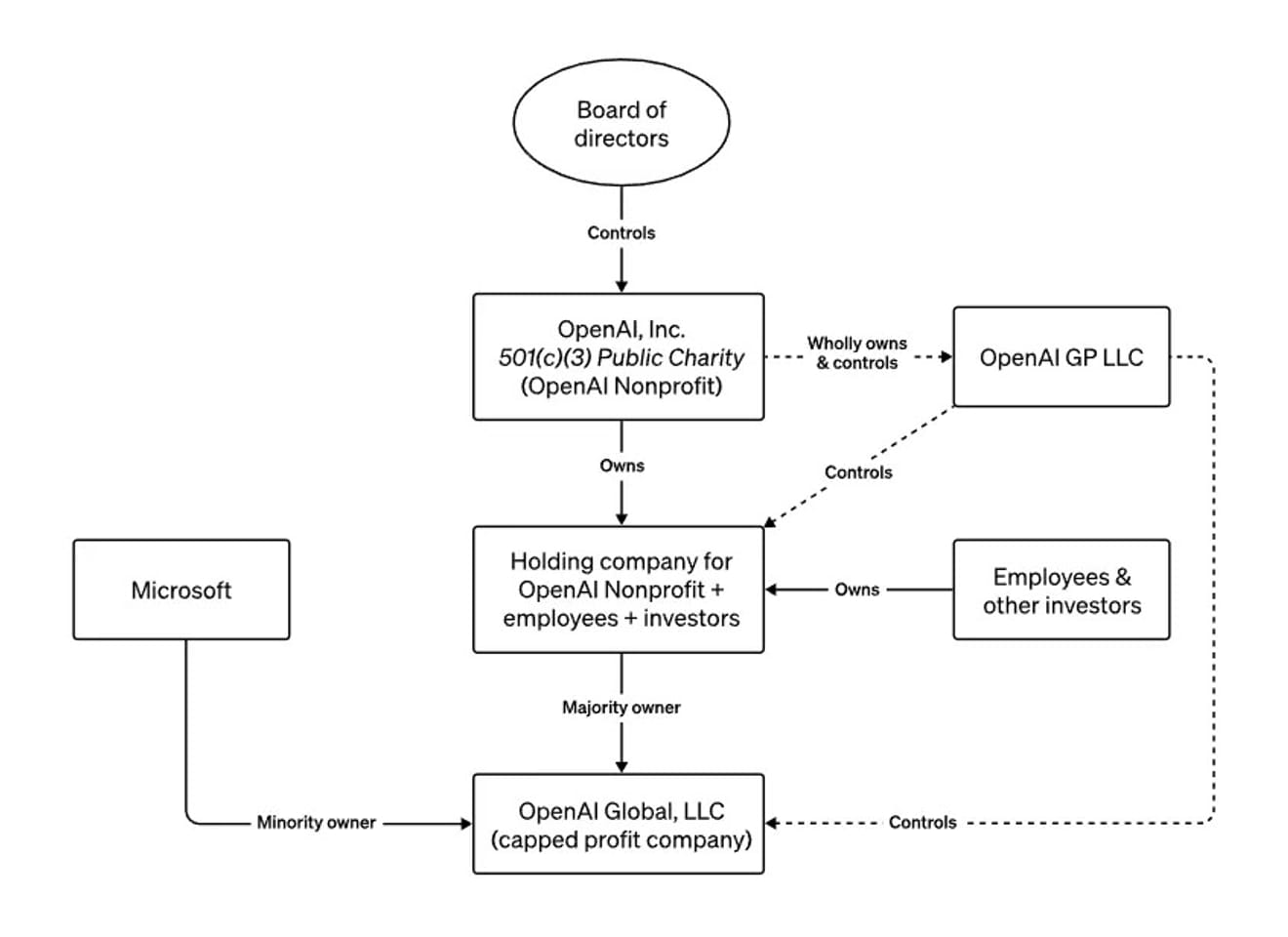

структура совета директоров OpenAI

В течение этого года Альтман объездил весь мир, предупреждая СМИ и правительства об экзистенциальных рисках разрабатываемых им технологий. Он описывал уникальную структуру OpenAI, сочетающую некоммерческую и коммерческую составляющие, как предостережение от безответственного развития мощного ИИ. В интервью Bloomberg в июне он также упомянул, что совет директоров может уволить его, если он будет действовать неосмотрительно или во вред человечеству. Другими словами, структура компании была преднамеренно создана таким образом, чтобы совет директоров, который ставит безопасность превыше всего, в том числе и в контексте появления неконтролируемого ИИ общего назначения (AGI), мог в любой момент уволить генерального директора.

Как же нам следует воспринимать нынешнюю ситуацию, когда новый генеральный директор OpenAI — это тот же самый, что и предыдущий?

Завершать эту историю как некий фарс, в котором ничего не изменилось, было бы неправильно. Дело в том, что мы убедились, что решения, касающиеся разработки этичного искусственного интеллекта, который может оказать наибольшее влияние на наше общество в наше время, принимаются крайне узким кругом лиц. Сэм Альтман в настоящее время является символом эпохи, когда внимание всего мира приковано к разработке и регулированию ИИ. Мы стали свидетелями того, как был фактически уничтожен практически единственный внешний инструмент, который мог бы сдерживать его действия и решения. Это позволило нам оценить важность появления других внешних инструментов контроля в будущем.

Кроме того, в результате этой ситуации стали более ясны позиции и интерпретации различных групп людей: пессимистов, считающих, что ИИ уничтожит человечество; трансгуманистов, которые верят, что технология ускорит наступление утопического будущего; сторонников свободного рынка и капитализма; а также тех, кто выступает за жесткое регулирование крупных технологических компаний, считая, что они не могут соблюсти баланс между потенциальным вредом от мощных разрушительных технологий и желанием извлечь из них прибыль. Примечательно, что все они исходят из страха перед будущим, в котором человечество будет сосуществовать с ИИ. В этом контексте важно отметить необходимость создания более разнообразных сообществ, которые могут прогнозировать это будущее.

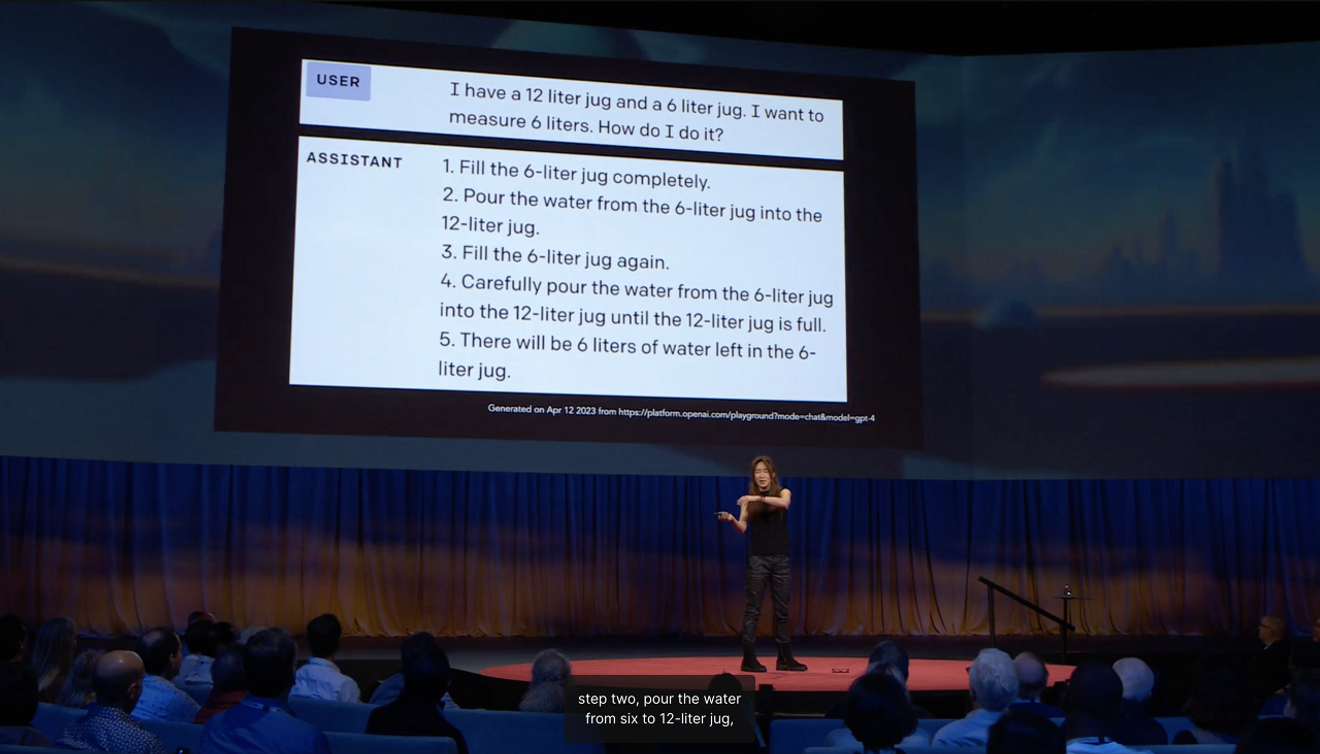

Чхве Йеджин, профессор Вашингтонского университета, которая вошла в список 100 самых влиятельных людей в области ИИ в мире, в своей лекции TED объяснила, почему искусственный интеллект, способный сдать любые государственные экзамены, совершает глупые и ненужные действия, например, добавляет лишние шаги при измерении количества воды (6 литров) с помощью двух чайников (12 и 6 литров). По её словам, это связано снедостатком обучения здравому смыслу, который люди получают в обществе.

При прогнозировании будущего мы часто, будучи внешними наблюдателями, определяем новое, ориентируясь на «границу», указывающую на направление движения мейнстрима. В этом случае то, что с внешней стороны кажется стабильным видением будущего, всегда в той или иной степени основано на текущей ситуации, то есть наабстрагированных ожиданиях, рожденных «живым опытом». Американский антрополог Арджун Аппадурай утверждал, что воображение — это не просто частная и индивидуальная способность, а социальная практика. Это означает, что различные представления о будущем могут стать реальностью. И нынешнюю ситуацию можно интерпретировать как один из пейзажей, созданных воображением, связанным с тревогой перед появлением ИИ общего назначения (AGI).

Учитывая, что ожидания лидеров отрасли в отношении будущего имеют важное политическое значение, в будущем нам потребуется более глубокое понимание будущего, которое коллективно воображается и формируется в различных социальных и культурных контекстах, при принятии решений о будущем ИИ. Сейчас самое время задаться вопросом: как можно создать больше возможностей для активного представления коллективных ожиданий, основанных на живом опыте, в различных сообществах?

Список источников

Комментарии0