เมื่อไม่นานมานี้ ภายในคณะกรรมการบริษัท OpenAI ซึ่งเป็นองค์กรไม่แสวงหาผลกำไรที่เติบโตจากศูนย์ถึงรายได้ 1 พันล้านดอลลาร์ต่อปีภายในเวลาไม่กี่เดือนหลังจากการเปิดตัว ChatGPT ได้เกิดเรื่องราวดราม่าอย่างใหญ่หลวงขึ้น ซีอีโอของบริษัทอย่างแซม อัลท์แมนถูกไล่ออก และหลังจากที่เขาประกาศย้ายไปทำงานที่ไมโครซอฟท์ เขาก็ได้รับการแต่งตั้งให้กลับมาดำรงตำแหน่งซีอีโอของ OpenAI อีกครั้ง โดยทั่วไปแล้ว ซีอีโอผู้ก่อตั้งบริษัทมักจะเป็นผู้ที่มีอำนาจมากที่สุดในบริษัท ดังนั้นการที่คณะกรรมการบริษัทจะไล่ซีอีโอผู้ก่อตั้งออกจึงเป็นเรื่องที่เกิดขึ้นได้ยากมาก โดยเฉพาะอย่างยิ่งกับบริษัทขนาดใหญ่ที่มีมูลค่าสูงถึง 80 พันล้านดอลลาร์นั้น แทบไม่มีใครกล้าแตะต้อง

ถึงกระนั้น เหตุการณ์ดราม่าที่เข้มข้นภายในเวลา 5 วันนี้ก็สามารถเกิดขึ้นได้ เนื่องจาก OpenAI มีโครงสร้างที่เป็นเอกลักษณ์ซึ่งผูกพันกับปณิธานขององค์กรที่ว่า 'เพื่อมนุษยชาติ' สมาชิกคณะกรรมการอิสระ 3 คนที่รายงานว่าเป็นผู้ผลักดันให้เกิดการตัดสินใจไล่อัลท์แมนออกนั้น ล้วนมีความเกี่ยวข้องกับลัทธิประโยชน์นิยมที่มีประสิทธิภาพ (EA, effective altruism) ซึ่งเชื่อมโยงกับปณิธานของบริษัท โดยมีเป้าหมายที่จะ 'ไม่ให้มนุษยชาติและทุกสิ่งทุกอย่างในเอกภพที่สังเกตได้หายไป'

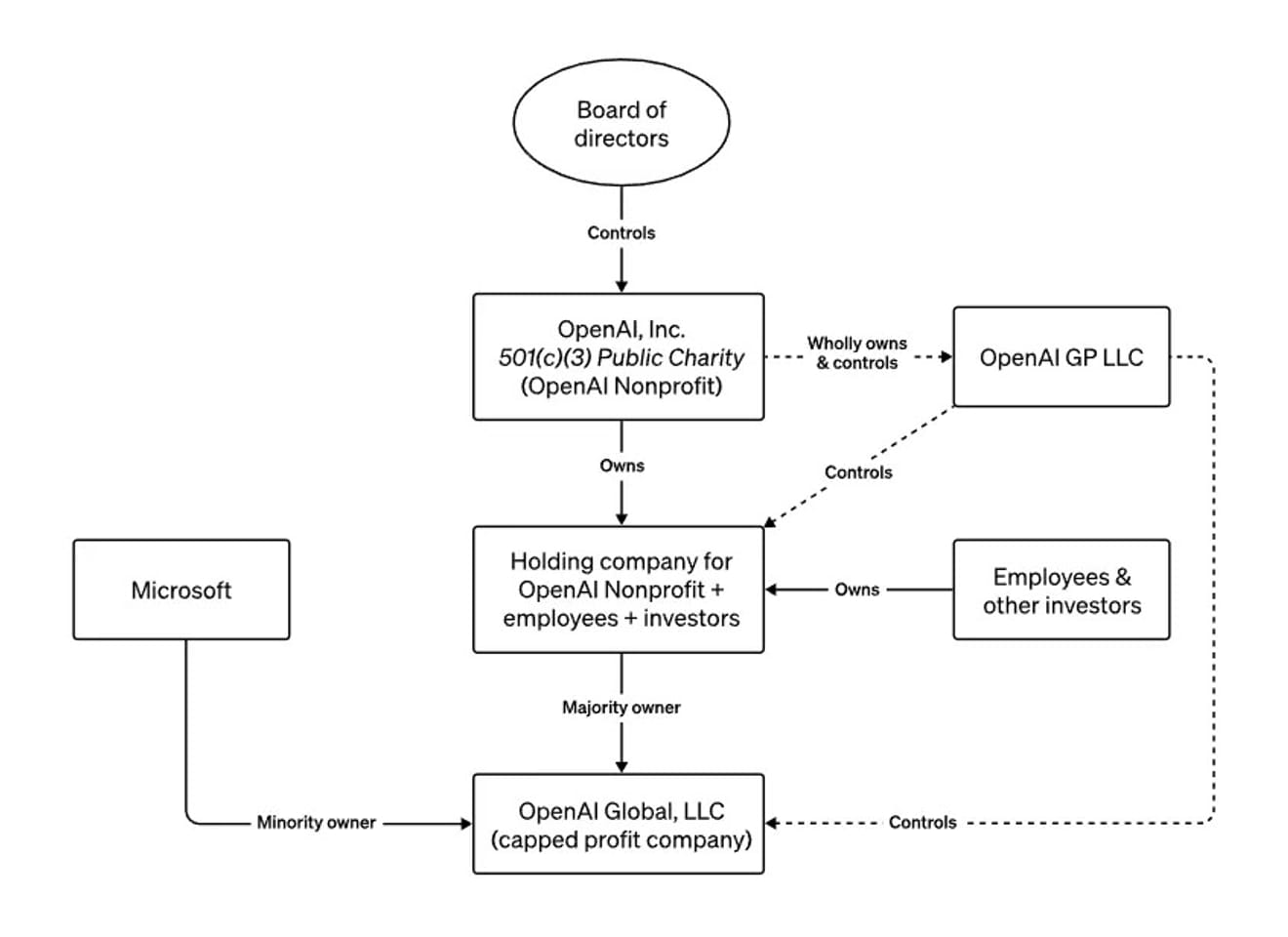

โครงสร้างคณะกรรมการของ OpenAI (the board structure of OpenAI)

ตลอดทั้งปีที่ผ่านมา อัลท์แมนได้เดินทางไปทั่วโลกเพื่อเตือนสื่อมวลชนและรัฐบาลเกี่ยวกับอันตรายจากการดำรงอยู่ของเทคโนโลยีที่เขากำลังพัฒนา และได้อธิบายถึงโครงสร้างที่ไม่เหมือนใครของ OpenAI ซึ่งเป็นโครงสร้างแบบไม่แสวงหาผลกำไรภายในโครงสร้างแบบแสวงหาผลกำไรว่า เป็นการเตือนภัยเกี่ยวกับการพัฒนา AI ที่ทรงพลังโดยไม่คำนึงถึงความรับผิดชอบ และในระหว่างการให้สัมภาษณ์กับบลูมเบิร์กเมื่อเดือนมิถุนายนที่ผ่านมา เขายังได้กล่าวถึงว่า หากเขาทำตัวเป็นอันตรายหรือกระทำการที่ขัดต่อผลประโยชน์ของมนุษยชาติ คณะกรรมการบริษัทก็สามารถไล่เขาออกได้ กล่าวคือ โครงสร้างนี้ถูกออกแบบมาโดยเจตนาเพื่อให้คณะกรรมการบริษัทซึ่งให้ความสำคัญกับความปลอดภัยมากกว่าเงิน และมีความกังวลเกี่ยวกับการเกิดขึ้นของ AGI ที่ควบคุมไม่ได้ สามารถไล่ซีอีโอออกได้ทุกเมื่อ

แล้วเราควรจะมองสถานการณ์ปัจจุบันที่ซีอีโอคนใหม่ของ Open AI เป็นคนเดียวกับซีอีโอคนก่อนหน้าอย่างไร?

เหตุการณ์นี้ไม่ใช่เรื่องบังเอิญที่จบลงด้วยการไม่มีการเปลี่ยนแปลงใดๆ เนื่องจากเราได้พบว่าการตัดสินใจที่สำคัญที่สุดอย่างหนึ่งในยุคสมัยของเรา ซึ่งเกี่ยวข้องกับการพัฒนาปัญญาประดิษฐ์เชิงจริยธรรมที่จะส่งผลกระทบต่อสังคมของเรามากที่สุดนั้น ได้ถูกตัดสินใจโดยคนเพียงไม่กี่คน แซม อัลท์แมนกลายเป็นสัญลักษณ์ของยุคสมัยที่ทั่วโลกจับตามองการพัฒนาและการกำกับดูแล AI และเราได้เห็นกระบวนการที่ทำให้กลไกภายนอกเพียงไม่กี่อย่างที่สามารถขัดขวางการตัดสินใจและการกระทำของเขาในอนาคตนั้นถูกยกเลิกไปในทางปฏิบัติ และทำให้เราระลึกถึงความสำคัญของกลไกภายนอกเพิ่มเติมในอนาคต

นอกจากนี้ เหตุการณ์ครั้งนี้ยังทำให้มุมมองและการตีความของผู้คนมีความชัดเจนยิ่งขึ้น ไม่ว่าจะเป็นผู้ที่กังวลว่า AI จะทำลายล้างมนุษยชาติ (ผู้มองโลกในแง่ร้าย) ผู้ที่เชื่อว่าเทคโนโลยีจะนำไปสู่ยุคทองของมนุษยชาติ (ผู้สนับสนุนเทคโนโลยีเหนือมนุษย์) ผู้ที่เชื่อมั่นในระบบทุนนิยมเสรี ผู้ที่สนับสนุนการกำกับดูแลอย่างเข้มงวดเพื่อควบคุมบริษัทเทคโนโลยีขนาดใหญ่ซึ่งเชื่อว่าไม่สามารถสร้างสมดุลระหว่างอันตรายที่อาจเกิดขึ้นจากเทคโนโลยีที่ทรงพลังและความต้องการในการทำกำไร และทั้งหมดนี้ล้วนเริ่มต้นจากความกลัวต่ออนาคตของมนุษย์ที่อยู่ร่วมกับ AI ดังนั้น เราจึงจำเป็นต้องใส่ใจกับความต้องการที่จะมีชุมชนที่หลากหลายมากขึ้นเพื่อช่วยในการคาดการณ์อนาคตนี้

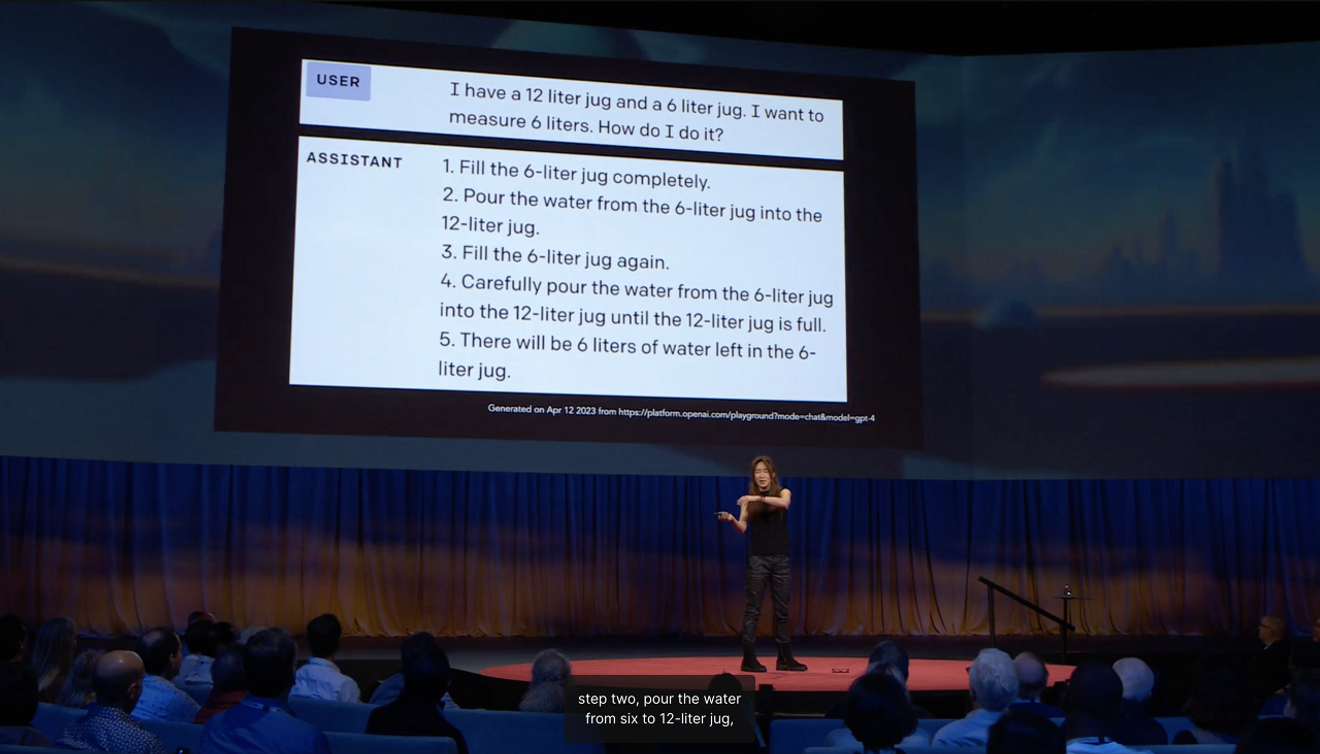

ศาสตราจารย์ชอย เยจิน แห่งมหาวิทยาลัยวอชิงตัน ซึ่งติดอันดับ 100 บุคคลที่มีอิทธิพลมากที่สุดในวงการ AI ของโลก ได้อธิบายในงาน TED Talk ของเธอว่า เหตุผลที่ปัญญาประดิษฐ์ที่สามารถสอบผ่านการสอบต่างๆ ของประเทศได้นั้นกลับทำการคำนวณปริมาณน้ำ 6 ลิตรจากกาต้มน้ำขนาด 12 ลิตรและ 6 ลิตรด้วยวิธีที่ดูโง่ๆ และไม่จำเป็นนั้น เกิดจากการขาดการเรียนรู้เรื่องสามัญสำนึกนั่นเอง

เมื่อเราพยายามคาดการณ์อนาคต เรามักจะมองหา 'ขอบเขต' ที่บ่งบอกถึงทิศทางของกระแสหลักจากมุมมองของผู้สังเกตการณ์ภายนอก เพื่อระบุสิ่งใหม่ๆ ในขณะนั้น สิ่งที่ดูเหมือนจะเป็นวิสัยทัศน์อนาคตที่มั่นคงจากภายนอกนั้น มักจะมาจากความคาดหวังที่เกิดจากการทำให้ความทรงจำที่สดใสเป็นนามธรรมโดยยึดตามปัจจุบัน นักมานุษยวิทยาชาวอเมริกันอย่าง อาร์จุน อัปปาดูไร ได้โต้แย้งว่า จินตนาการไม่ใช่ความสามารถส่วนตัวหรือส่วนบุคคล แต่เป็นการปฏิบัติทางสังคม ซึ่งหมายความว่าจินตนาการเกี่ยวกับอนาคตที่หลากหลายสามารถเกิดขึ้นจริงได้ และเราสามารถตีความเหตุการณ์ครั้งนี้ว่าเป็นหนึ่งในภาพที่จินตนาการเกี่ยวกับอนาคตที่ไม่แน่นอนเกี่ยวกับการถือกำเนิดของ AGI สร้างขึ้น

เนื่องจากเราพบว่าความคาดหวังของผู้นำในอุตสาหกรรมที่มีต่ออนาคตมีความสำคัญทางการเมือง ดังนั้นในอนาคต เราจึงจำเป็นต้องมีความเข้าใจที่ลึกซึ้งยิ่งขึ้นเกี่ยวกับอนาคตที่ถูกจินตนาการและสร้างขึ้นโดยกลุ่มคนในบริบททางสังคมและวัฒนธรรมที่หลากหลายในการตัดสินใจเกี่ยวกับอนาคตของ AI เราควรตั้งคำถามว่า เราจะสร้างโอกาสในการนำเสนอความคาดหวังร่วมกันที่เกิดจากประสบการณ์จริงในชุมชนที่หลากหลายได้อย่างไร

เอกสารอ้างอิง

ความคิดเห็น0