Cách đây không lâu, chỉ vài tháng sau khi ChatGPT ra mắt, OpenAI - một doanh nghiệp phi lợi nhuận đã đạt được doanh thu hàng năm 1 tỷ USD từ con số 0 - đã chứng kiến một bộ phim kịch tính đầy bất ngờ diễn ra trong hội đồng quản trị của mình. Giám đốc điều hành của công ty, Sam Altman, đã bị sa thải, và sau khi thông báo về việc chuyển sang làm việc tại Microsoft, ông đã được bổ nhiệm trở lại vị trí CEO của OpenAI. Thông thường, các CEO sáng lập là nhân vật quyền lực nhất trong một công ty, vì vậy việc hội đồng quản trị sa thải họ là điều hiếm khi xảy ra, đặc biệt là đối với một công ty khổng lồ có giá trị lên tới 80 tỷ USD.

Tuy nhiên, bộ phim kịch tính căng thẳng kéo dài 5 ngày này có thể xảy ra là nhờ vào cấu trúc độc đáo của OpenAI, dựa trên tuyên bố sứ mệnh 'vì nhân loại'. Ba thành viên độc lập trong hội đồng quản trị, được cho là đã chủ động đưa ra quyết định sa thải Altman, đều có liên quan đến chủ nghĩa vị tha hiệu quả (EA, effective altruism), một lý tưởng gắn liền với sứ mệnh của công ty, với mục tiêu 'đảm bảo sự tồn tại của nhân loại và toàn bộ vũ trụ quan sát được'.

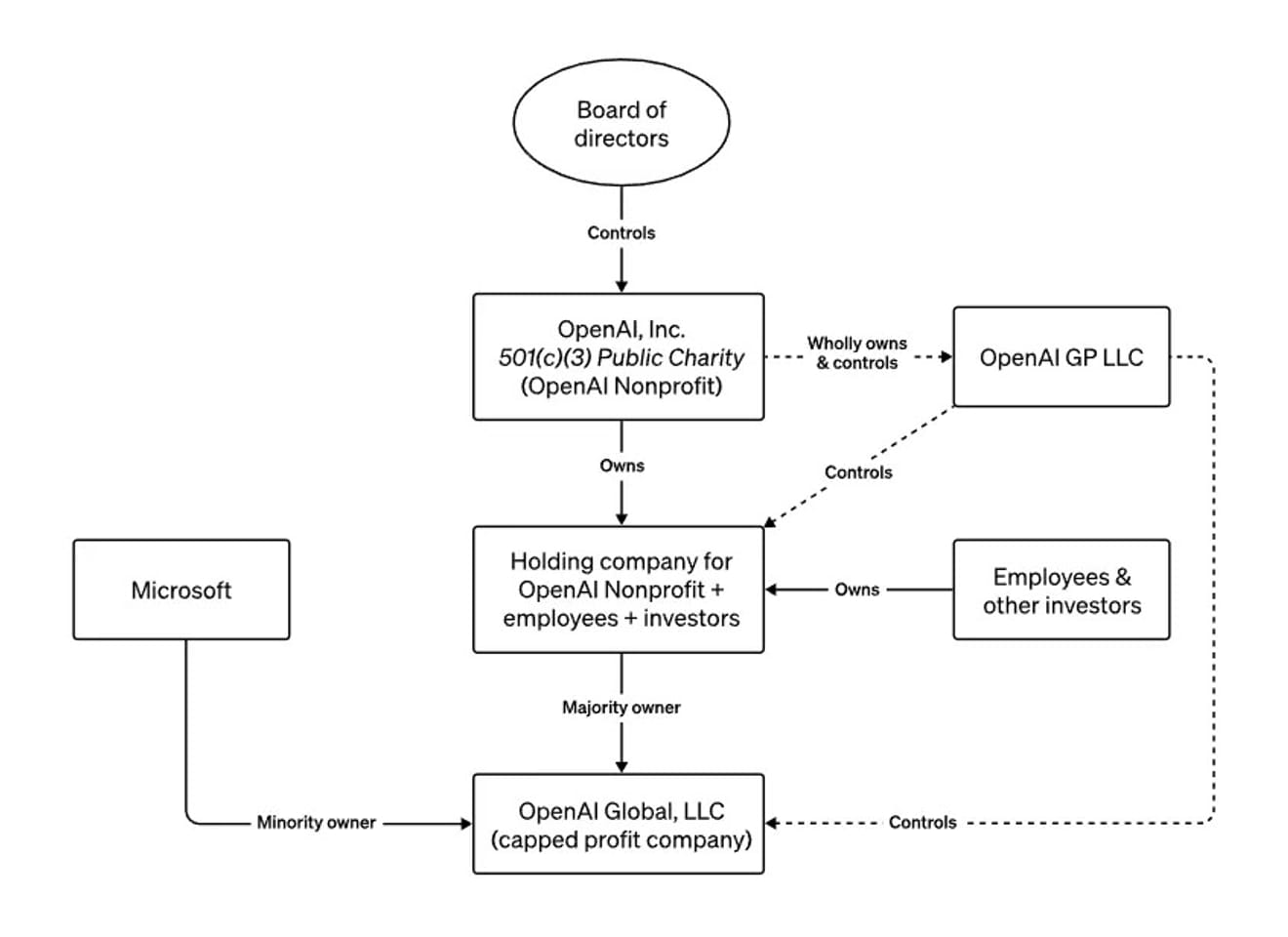

cấu trúc hội đồng quản trị của OpenAI

Trong suốt cả năm nay, Altman đã đi khắp thế giới, cảnh báo giới truyền thông và các chính phủ về những rủi ro hiện hữu của công nghệ mà ông đang phát triển. Ông đã mô tả cấu trúc đặc biệt của OpenAI, kết hợp giữa phi lợi nhuận và lợi nhuận, như một lời cảnh tỉnh về việc phát triển AI mạnh mẽ một cách thiếu trách nhiệm. Trong một cuộc phỏng vấn với Bloomberg hồi tháng 6, ông cũng đề cập rằng nếu ông thực hiện các hành động nguy hiểm hoặc trái với lợi ích của nhân loại, hội đồng quản trị có thể sa thải ông. Nói cách khác, đây là một cấu trúc được thiết kế có chủ đích, ưu tiên sự an toàn liên quan đến sự xuất hiện của AGI (Trí tuệ nhân tạo tổng quát) không thể kiểm soát hơn là tiền bạc, cho phép hội đồng quản trị có thể sa thải CEO bất cứ lúc nào.

Vậy, chúng ta nên nhìn nhận tình huống hiện tại, khi CEO mới của OpenAI lại chính là người tiền nhiệm, như thế nào?

Không thể kết thúc câu chuyện này bằng cách cho rằng đó chỉ là một sự việc không có gì thay đổi. Bởi lẽ, chúng ta đã nhận ra rằng những quyết định liên quan đến việc phát triển AI có đạo đức, có khả năng tác động lớn nhất đến xã hội hiện đại, lại được đưa ra dựa trên ý kiến của một nhóm người cực kỳ nhỏ. Sam Altman giờ đây đã trở thành biểu tượng cho một thời đại khi toàn thế giới đổ dồn sự chú ý vào việc phát triển và quản lý AI. Và chúng ta đã chứng kiến quá trình loại bỏ gần như duy nhất những phương tiện bên ngoài có thể ngăn chặn những phán quyết và quyết định trong tương lai của ông. Điều này càng làm nổi bật tầm quan trọng của các biện pháp bên ngoài bổ sung trong thời gian tới.

Hơn nữa, sự kiện này đã làm rõ hơn quan điểm và cách giải thích của các bên liên quan, bao gồm những người hoài nghi về AI (cho rằng AI sẽ hủy diệt nhân loại), những người theo chủ nghĩa siêu nhân (tin rằng công nghệ sẽ thúc đẩy một tương lai tươi sáng), những người ủng hộ chủ nghĩa tư bản tự do, và những người ủng hộ các quy định nghiêm ngặt nhằm kiềm chế các công ty công nghệ khổng lồ (cho rằng họ không thể cân bằng giữa rủi ro tiềm ẩn của các công nghệ mang tính phá vỡ và lòng tham kiếm lợi nhuận). Tất cả đều bắt nguồn từ nỗi sợ hãi về tương lai của con người khi phải sống chung với AI, và điều này cho thấy sự cần thiết phải có thêm nhiều cộng đồng khác nhau để dự đoán tương lai.

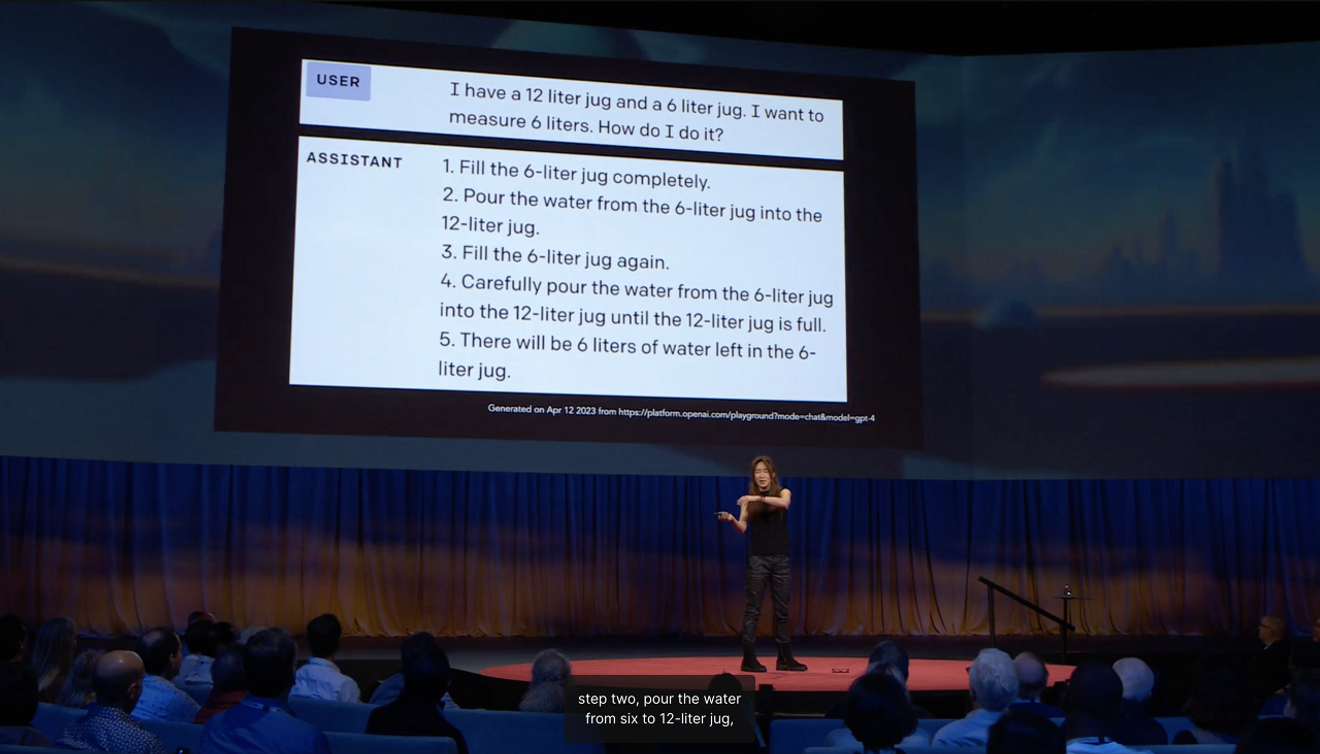

Giáo sư Choi Ye-jin của Đại học Washington, người từng được lọt vào danh sách 100 người có ảnh hưởng nhất thế giới trong lĩnh vực AI, đã giải thích trong bài thuyết trình TED của mình rằng lý do tại sao một AI có thể vượt qua các kỳ thi công chức lại có thể thực hiện những thao tác thừa thãi và ngớ ngẩn như thêm các bước không cần thiết khi đo 6 lít nước bằng hai ấm nước 12 lít và 6 lít là dosự thiếu hụt kiến thức thường thức mà con người tiếp thu trong xã hội.

Khi dự đoán tương lai, chúng ta thường xác định những điều mới mẻ từ góc nhìn của người ngoài cuộc, dựa trên 'giới hạn' thể hiện hướng đi của xu hướng chính thống. Trong trường hợp này, những gì được xem là tầm nhìn ổn định về tương lai từ bên ngoài thường dựa trên 'hiện tại', cụ thể hơn lànhững kỳ vọng được trừu tượng hóa từ “kinh nghiệm sống sinh động”. Nhà nhân chủng học người Mỹ Arjun Appadurai đã từng lập luận rằng trí tưởng tượng không chỉ là một khả năng cá nhân, riêng tư mà còn là một hành động xã hội. Điều này có nghĩa là trí tưởng tượng về nhiều tương lai khác nhau có thể trở thành hiện thực. Sự kiện vừa qua có thể được hiểu là một trong những khung cảnh do trí tưởng tượng về một tương lai bất ổn liên quan đến sự xuất hiện của AGI tạo ra.

Nhận thấy rằng kỳ vọng của các nhà lãnh đạo ngành nghề hướng tới tương lai mang ý nghĩa quan trọng về mặt chính trị, chúng ta cần phải có sự hiểu biết sâu sắc hơn về tương lai được hình thành và tưởng tượng tập thể trong nhiều bối cảnh xã hội và văn hóa khác nhau khi quyết định tương lai của AI. Đã đến lúc đặt câu hỏi: Làm thế nào để tạo ra những cơ hội cho các kỳ vọng tập thể, dựa trên kinh nghiệm sống sinh động trong nhiều cộng đồng đa dạng, được đưa ra một cách tích cực?

Tài liệu tham khảo

Bình luận0